豆瓣高分美劇【了不起的麥瑟爾夫人】故事背景為 20 世紀 50、60 年代,女主爸爸是在哥倫比亞大學擔任終身教授的數學家,當他得知女兒兼職脫口秀演員時,十分震驚和不解。

幾十年後的今天,在中國香港「卻有」一位科學家在兼職脫口秀,他就是即將加入華為公司的香港理工大學博士後廖付友。

圖 | 論文第一作者廖付友博士表演脫口秀(來源:廖付友)

其研究方向是半導體器件與工藝,2022 年大年初三,廖付友和導師港理工套用物理系教授柴揚,在 Nature Electronics 發了一篇論文。

圖 | 相關論文(來源: Nature Electronics )

農歷大年初八, Nature 官網以研究亮點(RESEARCH HIGHLIGHT)形式報道了這一工作,其上寫道:「適應各種光強度半導體的器件,或可用於自動駕駛汽車和工業生產線。」

圖 | Nature 官網研究亮點報道(來源: Nature 官網)

模擬人眼視網膜,研發仿生視覺適應傳感器

該工作的背景在於,在人類生活環境中,從烈日當空的正午、到伸手不見五指的漆黑夜晚,自然光的強度分布非常廣。如何在不同光照條件下準確提取外部環境的資訊,是一個基礎科學問題,具有非常實際套用的意義。

隨著機器視覺的發展、及其在自動駕駛和即時視訊分析等領域的套用,高分辨率、高影像捕獲速度成為視覺傳感器的必備能力,具體體現為良好的穩定性、以及寬感知範圍,即在不同光照強度下感知目標的能力。

據悉,地球上自然光強度的分布超過 280dB,因此對於正確感知環境來說,在不同光照下準確捕獲影像尤為重要。這就要求光電器件在弱光、以及亮光照明下,必須準確捕捉和感知細節。

目前,市場上主流的矽基 CMOS(互補金氧半導體,Complementary Metal Oxide Semiconductor)影像傳感器通常只有 70dB 的感知範圍,遠低於自然場景的光強變化範圍。

為實作較寬的感知範圍,此前有學者探索過控制光學孔徑、使用液態透鏡、調節曝光時間、以及後端去噪演算法等方法,但這些方法通常需要復雜的硬體和軟體資源。

因此非常有必要在傳感器終端發展出一種具有視覺適應功能和寬感知範圍的光電器件,從而改善機器視覺的功能、降低硬體復雜性、並提升高影像辨識效率。

相比矽基光電探測器,人眼的光接收細胞感知範圍比較有限只有 40dB,但是人眼的視覺適應功能讓我們可以感知和辨識不同光照條件下的各種物體,哪怕是從較暗環境、轉換到較亮環境中。

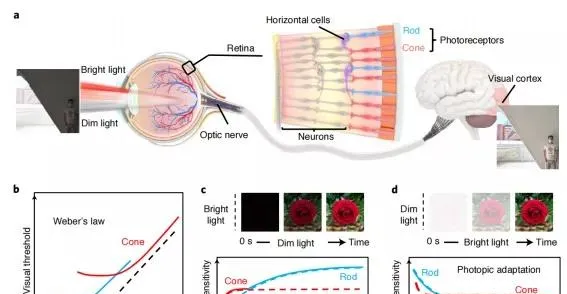

(來源: Nature Electronics )

人眼的視覺適應機制,依賴於每個光接收細胞在不同光照條件下光靈敏度的動態調節,其調節原理是在不同光照條件下,水平細胞控制視錐和視桿細胞之間的轉換、以及光色素的產生和消失。

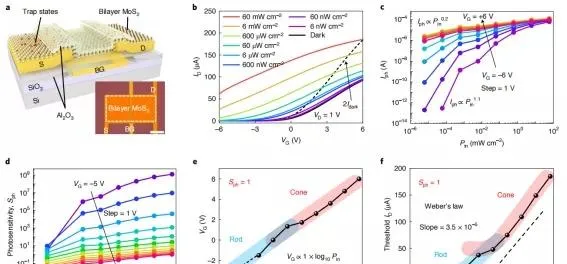

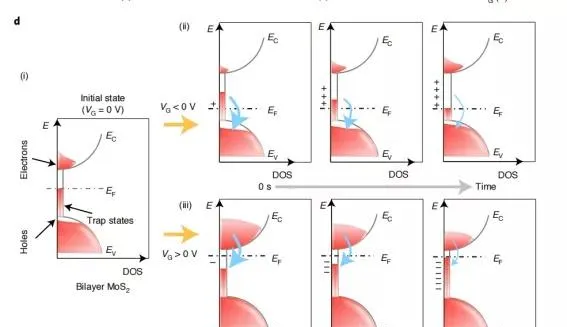

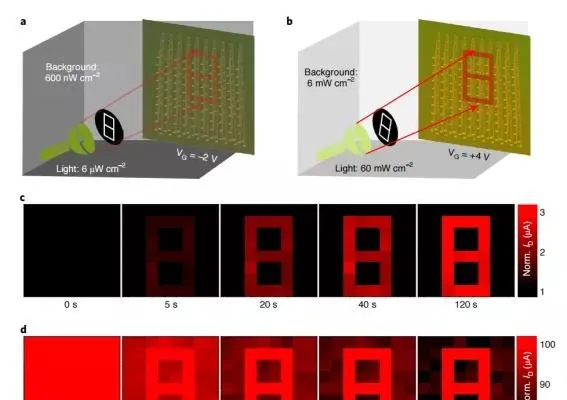

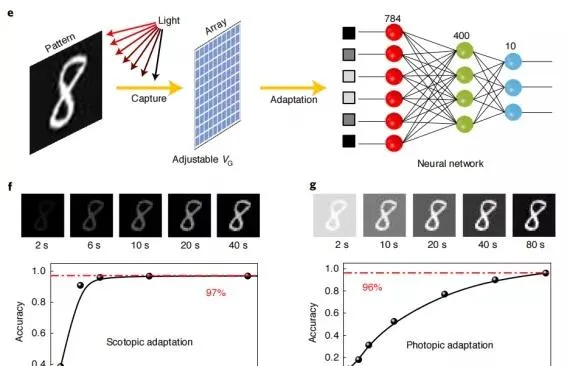

在該工作中,柴揚和團隊研發出一種基於底柵光電晶體管陣列的仿生視覺適應傳感器。該器件模擬了水平細胞和光接收細胞的結構,具有視覺亮適應和暗適應的功能,有效感知範圍達到 199dB。

利用這款傳感器,可在不借助大體積光學元件、以及復雜外圍電路和後端訊號處理的條件下,實作視覺適應功能和寬感知範圍。

(來源: Nature Electronics )

柴揚表示,其團隊在 5 年前就已開展光電記憶體的研究,這種新型器件能將光傳感與光資訊處理的功能在單一器件中完成。

2018 年,該團隊發表了第一篇關於將光傳感器與邏輯資訊處理整合的論文[2]。隨後,在此研究基礎上進一步開展,2019 年柴揚等人設計並利用光控阻變隨機記憶體實作了影像感知和影像預處理的功能[3]。

在 2020 年,他們又率先提出近傳感器和傳感器內計算的方法[4,5]。人眼視網膜可以感知外界光訊號,並根據光照強度自動調節光接收細胞的靈敏度,從而適應不同的背景光強度,這便是視網膜的視覺適應功能。

(來源: Nature Electronics )

例如,去電影院的時候,從明亮大廳走進黑暗電影廳時,剛開始眼前一片漆黑,過段時間後才能看清周圍環境,這便是視覺暗適應過程。

而在剛看完電影從電影院走出來後,假如走在陽光下會覺得很刺眼,要等一會才能看清周圍的景物,這一過程叫視覺亮適應,這和視覺暗適應過程正好相反。

受到視網膜結構和功能的啟發,柴揚開始研究具備視覺適應功能的仿生視覺傳感器。

他說,雖然此前也有類似工作的少量報道,但往往只能實作視覺亮適應功能,並不能模擬視網膜的暗適應過程,距離完整的視覺適應功能還有較大距離,最主要原因在於很難讓同一個光電器件同時擁有光電增強和光電抑制這兩種相反的特性。

為解決這一難題,該團隊設計了光電晶體管型的視覺傳感器,透過施加不同的柵極電壓的來控制器件視覺亮適應和暗適應程度,從而模擬視網膜中光接收細胞和水平細胞的結構和功能,最終制備出仿生視覺適應傳感器。

有潛力用於自動駕駛、人臉辨識和太空探測

柴揚介紹稱,該成果有潛力套用於自動駕駛、人臉辨識和太空探測。

在自動駕駛領域當汽車突然進入非常暗或非常亮的環境中時,視覺傳感器可根據光照條件在傳感端,實作光靈敏度的調節,進而準確感知影像。

這樣的好處在於,無需經過後端影像處理器或雲端資訊處理,大大提升了系統的資訊處理效率。

人臉辨識也是一個重要套用場景,當室外網路攝影機工作時,晝夜光強變化範圍大,無論是白天的強光還是夜間的黑暗,視覺傳感器能根據背景光強度,去調節光靈敏度從而準確辨識人臉。

在太空探測領域,太空中或一些星球上的光強分布範圍很廣,把具有視覺適應功能的寬感知範圍視覺傳感器套用在探測裝置上,除了正常光照條件下的感知外,還可以在極端光照條件下(極弱或者極強光)探測外界環境和辨識目標。

這時,假如在機器人中使用具有視覺適應功能的仿生視覺傳感器,將進一步提升機器人視覺系統的智慧程度。

(來源: Nature Electronics )

對於後續計劃,柴揚表示盡管此次展示了仿生視覺適應傳感器的概念,並且具有較大的感知範圍,但是視覺適應速度也和人眼的適應速度相當,因此要想套用在實際產品中,還有一系列問題需要解決。

柴揚曾表示其目標是「開發未來可廣泛套用於半導體行業的器件結構」。該團隊的後續計劃主要有四方面:其一,進一步提升器件的視覺適應速度,以實作微妙到幾十微秒量級;其二,進一步降低器件功耗,把器件現有功耗再降低 10 倍以上;其三,實作更大規模的器件陣列制備,近期目標是 100×100;其四,實作異質整合,將仿生視覺適應傳感器和矽基控制電路整合在一起。

(來源: Nature Electronics )

另據悉,該團隊的科研成果還曾受到香港特區行政長官林鄭月娥的關註。2021 年 7 月,香港特區行政長官林鄭月娥前來香港理工大學參觀存取,柴揚科研團隊透過實物演示和講解的方式,向特首介紹了仿生視覺適應傳感器。聽完介紹後,林鄭月娥非常感興趣,並詢問了該成果的套用前景和產業化問題,最後鼓勵他們做出更多的成果。

圖 | 柴揚(左三)向香港特區行政長官林鄭月娥(右一)介紹仿生視覺適應傳感器(來源:柴揚)

放棄春節休息,大年初一堅持科研

據悉,此次發表發論文計畫始於 2020 年,當時香港的新冠疫情非常嚴重,論文第一作者廖付友冒著疫情逆向而行來到香港加入柴揚團隊。

圖 | 柴揚團隊於 2021 年 4 月在香港太平山頂合影(左一為論文第一作者廖付友博士,左四為論文通訊作者柴揚老師)

在香港隔離結束後,廖付友立馬全身心投入研究,在最初幾個月,實驗進展並不順利,早期實驗方案均以失敗告終。團隊成員一起反復討論找出問題所在,重新設計方案之後,一步一步取得新進展。

2021 年農歷大年三十,該團隊收到了南韓合作方安炯炫(Jong Hyun Ahn)郵寄的最新樣品。2021 年農歷正月初一到初四春節假期時間,廖付友放棄休假,每天從早上 8 點到晚上 10 點連續測試四天,取得了更多的進展。

柴揚表示,廖付友生性樂觀,善於把團隊成員揉合在一起,並能與外部合作者有效溝通,為團隊起到了不可替代的傳幫帶的作用。

在科研以外,廖付友興趣愛好廣泛,曾考取 IFBB(International Federation of Bodybuilding and Fitness,國際健美聯合會)健身教練證書和IBFA(International Body Resistance And Fitness Training Association,國際身體阻力與體適能訓練協會)營養師證書,經常給課題組成員科普健身知識,給團隊塑造出強身健體的氛圍。

此外如前文所述,廖付友還是深圳某脫口秀俱樂部的兼職演員,擅長將科研生活改編成段子。平日裏,他風趣幽默的說話方式給課題組的日常生活帶了一些樂趣。

對於未來的職業發展,廖付友表示,博後結束後將會加入上海華為技術有限公司,繼續從事半導體器件與工藝方面的研發工作,希望自己這些年的研究經驗可以繼續在工業界發光發熱。

-End-

參考:

1、Liao, F., Zhou, Z., Kim, B.J. et al. Bioinspired in-sensor visual adaptation for accurate perception. Nat Electron (2022). https:// doi.org/10.1038/s41928- 022-00713-1

2、 Advanced Functional Materials ,2018, 28, 1800080

3、 Nature Nanotechnology , 2019, 14, 776-782

4、 Nature ,2020,579,32-33;

5、 Nature Electronics , 2020, 3, 664-671