結論前置:

對於類似HTC Vive的裝置,需要雙目12450*6840或更高的分辨率(介於8k和16k之間)才能達到「視網膜」效果。對於所有VR裝置,需要達到150-240fps的重新整理率才能讓一般人覺得足夠真實。

如此高的分辨率和重新整理率需要數十倍於當前PC的硬體效能才能驅動。

「視網膜」效果是一個沒有清晰定義的概念。根據Steve Jobs在釋出iPhone 4時的定義,它是指在10-12英寸的距離上,裝置的像素密度達到300ppi(每英寸300像素)的水平時的顯示效果[1]。然而實際上人眼在12英寸的距離上的分辨率可以超過900ppi[2]。我們在這裏采用Jobs的標準來討論。

12英寸距離上300ppi的像素密度,通常用一個單位為ppd(每度像質數)的參數來表示:

ppd = 2drtan(0.5^{\circ } )

想象一個頂角為1°的細長的等腰三角形,其高度 d 為眼睛與螢幕的距離,r 即為其底邊覆蓋的像質數量。根據Jobs的定義,要獲得視網膜顯示效果,需要至少57ppd。

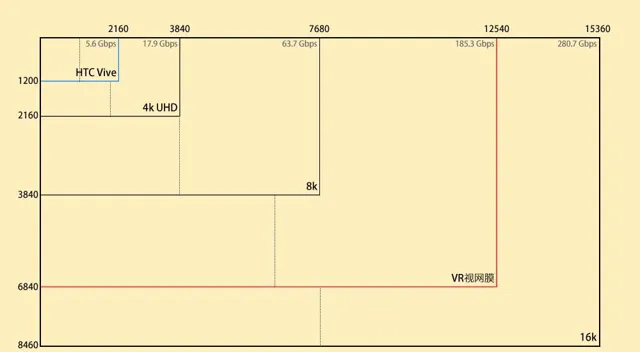

對於主流VR頭顯如HTC Vive來說,其單眼橫向FOV為110°,縱向約120°。據此計算,它需要

(110\times 57)*(120\times 57)=6270*6840

的單眼分辨率才能達到視網膜水平,也就是需要一塊至少 12540*6840 的螢幕輸出雙目畫面。按照類似流行的4k、5k、8k 的說法,這樣一塊螢幕差不多是13k;如果維持Vive顯示面板大小不變的話,其像素密度約為2567 ppi(作為對比,Vive的像素密度約為447 ppi)。至於有的朋友提出這樣高的像素密度能否實作,我覺得應該是沒什麽問題的,畢竟Sony早在2013年就造出了2098 ppi的OLED螢幕[3]。

如上圖。目前的主流VR頭顯的像素密度只達到了這一標準的1/6。我們在主流顯示裝置的像素密度上翻的前一個6倍,花了二十多年(從DOS時代的320*200到目前主流的1920*1080)。

提高VR裝置的像素密度,並不是單純地把高密度顯示面板造出來然後放進頭顯這麽簡單。從2k到4k、4k到8k,每次升級看上去都只是數位翻了一倍,然而像質數量卻是呈平方級上升的,4k是2k的4倍,8k是2k的16倍。視網膜VR級別的分辨率,其像質數量是目前Vive的33倍。

為了滿足VR遊戲的需求,目前最頂級的PC的效能都可以被輕易榨幹。3D遊戲的效能是與分辨率密切相關的,這意味著如果要提供相匹配視網膜VR的3D遊戲內容,電腦的效能也要相應地提升幾十倍。以莫耳定律計算,這個過程需要近10年。

視訊訊號的傳輸也是一個大問題。上圖每個方塊右上角給出了在該分辨率下以90 Hz的頻率發送未壓縮的每像素24 bit的視訊訊號所需要的頻寬(不含音訊)。作為參考,目前最新的HDMI 2.0標準可以傳輸最大18 Gbps的頻寬——連視網膜VR所需求頻寬的1/10都達不到。為此,我們必須使用更先進的傳輸方式,例如光纖傳輸。尚在繈褓之中的無線傳輸則會面臨更大的挑戰(開個腦洞,近場雷射傳輸?)。

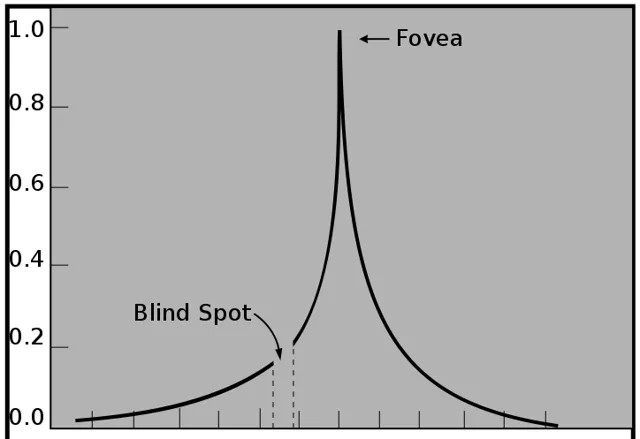

很多朋友提到,由於人眼只能清晰地看到聚焦點周圍很小的範圍(2°)[4],利用這一特性,我們可以透過降低周圍的分辨率來降低對像質數量的需求,以及電腦和傳輸效能的要求。

上圖是人類左眼的分辨率曲線(CC-BY-SA 3.0授權)。可見只有眼球中央凹(Fovea centralis)附近的區域有較高的分辨率,周圍的分辨率急轉直下,甚至不及中央十一。

要利用這一特性,我們需要在VR頭顯中植入眼球追蹤裝置。它可以透過追蹤眼球中央凹的移動來獲知使用者的眼睛正看向哪個點,然後在這一點周圍使用全解析度渲染,其他地方使用低解析度渲染。目前眼球追蹤技術已經非常成熟,但相關產品都還是以頭顯外掛程式的方式存在,比如我們這裏有一只樣機,可以插入Vive頭顯使用;但由於裝置太大,戴眼鏡的使用者就無法使用了;這個裝置需要使用USB線連線,走線上也很繁冗。不過相信下一代的VR頭顯就會開始整合此類裝置,也就不存在這些問題了。根據nVidia的說法,套用這一技術可以將渲染效能提高2到3倍[5][6]。

不過眼球跟蹤並不能實際降低對頭顯像質數量的需求。有的朋友在此基礎上設想了一種機構,使得顯示面板可以快速根據眼球的位置來移動,這樣就只需要極低的分辨率了。我不能否認這種技術在未來出現的可能性,但人眼的轉動速度可以達到900°/s[7],很難想像有何種裝置既能夠提供足夠的扭矩來低延時地跟蹤這樣高速的移動,又能小到能放進頭顯裏(開個腦洞,也許使用類似Olympus微單防抖系統那樣的磁懸浮面板?)。

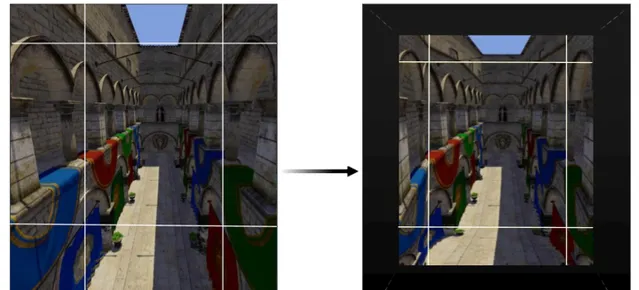

換一種思路,由於目前的VR頭顯都是透過一塊(菲涅爾)透鏡來將矩形(接近正方形)的顯示面板矯正為符合人眼的視野,面板上的某些像素實際上是被浪費掉的。譬如面板上只有內接的近圓形區域裏的內容才會被看到,四個角上的像素實際上是完全用不到的,所以根本不需要去渲染。再比如由於透鏡的特性,邊緣的可視像素密度比中心要低,因此也沒有必要使用全分辨率渲染。nVidia的Multi-res Shading技術就利用了這一特性,使得渲染效能可以提高33%-50%[8]。

nVidia Multi-res Shading示意圖,邊緣的部份像素密度較低,因此以較低的精度渲染。

盡管這些技術看上去能有效地節約像質數量,但需要註意的是,因為生產難度和成本問題,實際情況下基本上不可能去生產像素密度不均勻的顯示面板。因此這些技術只能用於緩解對電腦效能的要求。

重新整理率方面,盡管我們知道24 fps已經能提供連續的畫面、60 fps的遊戲對於絕大多數人來說已經足夠流暢;對於VR來說,為了提供足夠的沈浸感,這些重新整理率都遠遠不夠。理論上人眼最大可以感知到1000 fps的畫面(維基百科說的,我也沒有查到參照來源);對於未經訓練的人來說,150-240 fps的畫面已經顯得足夠真實[9]。因此Vive、Oculus的90 Hz,以及PSVR的120 Hz都還太低。而如果要達到理想的重新整理率,VR對機器效能的需求和傳輸頻寬的壓力還會進一步提升一到兩倍。

[1]:

Retina Display - Wikipedia[2]:

Why Retina Isn't Enough [Feature] | Cult of Mac[3]:

Insanely high 2098PPI OLED display from Sony makes your 1080p smartphone weep at night[4]:

Fovea centralis - Wikipedia[5]:

https:// research.nvidia.com/sit es/default/files/publications/foveated-sig16-etech.pdf[6]:

NVIDIA Says New Foveated Rendering Technique is More Efficient, Virtually Unnoticeable[7]:

Saccade - Wikipedia[8]:

NVIDIA VRWorks™[9]:

Frame rate - Wikipedia