先講個老話題。

自動駕駛,機器駕駛比人類駕駛安全嗎

[汽車智慧駕駛] 系列文章請移步專欄:汽車智慧駕駛 - 知乎 (zhihu.com)

初看蘿蔔快跑無人車

百度蘿蔔快跑引爭議,為什麽大家都在做Robotaxi

再看FSD,自動駕駛演算法訓練

再看L3——跳過L3,直接到L4?

再看L3上路通行試點,L3什麽時候能正式上路?

為什麽國內不能用FSD 第2話

如何看待自動駕駛車輛的shadow mode

自動駕駛,再看視覺路線和雷射雷達路線

AI「湧現」,大模型與自動駕駛

2024年了,端到端的自動駕駛解決方案怎麽樣了

城市NOA與開城,2024自動駕駛第一個必爭之地

本文參考資料:

Waymo用數據為自動駕駛代言:比人類司機安全6.8倍,超1149萬公裏僅3起事故_騰訊新聞 (qq.com)

Cruise為何被吊銷自駕營運執照,第三方調查報告揭秘 (baidu.com)

加州開放Robotaxi一周:Cruise連發三起事故,車隊規模被減半 (baidu.com)

0 引言 機器駕駛是否比人類駕駛安全

關於機器駕駛是否比人類駕駛安全,其實其中因素很多。

當道路上機器駕駛車輛與人類駕駛車輛並存時,需要一段時間磨合的。近來眾多關於蘿蔔快跑的討論其實也是因此而生。

0.1 智慧駕駛與行人

之前回答過:【行人與智慧車是否能理解彼此的套路呢,行人走在智慧車居多的道路上是否變得不安全了呢?】

這當然是相對的。問題可以rephrase為:自然人與機器駕駛的車輛相比,哪個對於行人更安全?

論反應速度和耐久,大部份人是比不過機器的,而且機器不會累,同樣開了5小時的汽車,機器駕駛的車輛對於行人來說更安全。

論應對能力,不同自然人個體之間也是有差異的,機器的反應能力取決於演算法,總體來說應該是能達到平均自然人的水平的。

但同時應對方式還取決於規則,比如關鍵時刻,如果車上沒有乘客,是否能透過撞毀車來保護行人不受傷害,取決於演算法。

0.2 智慧駕駛與路上其他駕駛員

【智慧機器與人的協作理解不如人與人的協作理解安全可靠嗎?】

從理解彼此行為的角度上來說,個人覺得,在車輛相同的情況下,一輛機器駕駛的車輛和一輛人類駕駛的車輛互相理解彼此行為的程度,與兩輛人類駕駛的車輛之間對於駕駛行為的理解程度,並不會有很大差異。

從溝通的角度來說,人類之間更容易溝通是因為對語氣、語速、表情和動作等的熟悉,而機器人沒有相關的特征。

但是車輛駕駛行為不存在駕駛員的切換而導致變化的特點。所以如果僅從理解彼此駕駛行為的角度,個人覺得一輛機器駕駛的車輛和一輛人類駕駛的車輛互相理解的難易程度與當前並不會有很大差異。

0.3 智慧駕駛需要智慧交通

智慧交通是自動駕駛實施的必要條件。在自動駕駛充分成熟的時代,智慧交通應該也發展到相當程度,對道路上的車輛進行合理管控。

安全需要基礎設施如網路攝影機物聯網智慧交通的配合。

1 規範的成熟度。現在自動駕駛上市會有很多的法規分歧,比如事故責任分配等。

2 車路協同的成熟度。如果完全自動駕駛,所有車都自動駕駛,那安全的實作就依賴於車-車溝通和車-路溝通。

之前還回答過一個問題:

【自動駕駛能相信嗎?】

完全自動駕駛的安全性不是相信自動駕駛還是相信人的問題,而是溝通與安全的問題。

如果路上人駕駛車輛居多,那自動駕駛車輛更危險。因為「人」對於自動駕駛車輛的駕駛邏輯是沒有清楚概念的,同時「人」的駕駛具有更多隨機性,自動駕駛車輛未必能完全應對得當。

如果路上都是自動駕駛的汽車,而你自動駕駛,那這輛車無疑比其他車更危險,因為對於「人」的行為的預判是最難的,而自動駕駛車輛相互之間能理解彼此套路。

0.4 機器駕駛與人類駕駛哪個更有優勢

人類駕駛和機器駕駛各有各的優勢。

個人覺得機器相比人的優勢是不疲勞,反應速度快。但是決策是否最優的評判是很復雜的。這也是為什麽要用視覺要用端對端要用大模型的原因,就是為了盡可能接近人的決策。

但這裏邊會逃不過這兩點的討論,

1)柯爾伯格道德兩難論

如果一輛失控的卡車撞向火車還是撞上一群行人?

不同的人會做出不同的選擇,那機器邏輯演算法應該如何設定?

2)阿西莫夫機器人三大原則

第一定律。機器人不得傷害人類,或看到人類受到傷害而袖手旁觀。

第二定律。機器人必須服從人類的命令,除非這條命令與第一定律相矛盾。

第三定律。機器人必須保護自己,除非這種保護與第一和第二定律相矛盾。

接下來我們看看幾家比較大的智駕營運公司目前的情況。

1 百度

5月15日,百度在Apollo Day 2024釋出了全球第一個支持L4級自動駕駛的大模型Apollo ADFM(Autonomous Driving Foundation Model)。宣稱安全性高於人類駕駛員10倍以上。

據稱,百度Apollo ADFM基於大模型技術重構自動駕駛,可以兼顧技術的安全性和泛化性,實作城市級全域復雜場景覆蓋。

截至2024年4月,百度Apollo的自動駕駛裏程已經超過1億公裏,未發生過重大傷亡事故。同時,百度Apollo為每輛無人車及乘客購買了500萬的保險,過去兩年的數據顯示,實際車輛出險率僅為人類司機的1/14。

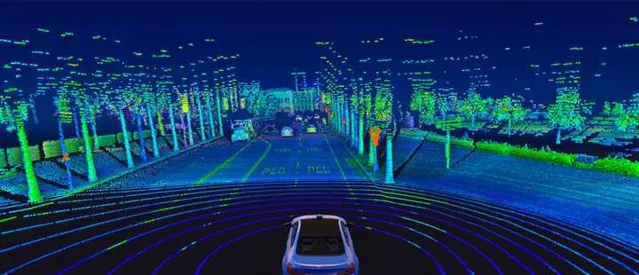

1.1 感知

Apollo ADFM感知大模型實作包括 檢測、跟蹤、理解、建圖 這幾項基本能力。

其中感知大模型中的基礎模型透過 點雲和視覺多模態融合 的方式,實作了相機和主動光不同型別傳感器的優勢互補,兼顧深度、準確性和資訊豐富程度。

在數據處理上,實作了更完善的 數據自標註 ,將原始數據 批次自動化轉化為粗標數據以及精標數據 ,極大程度的解決了標註數據獲取這一困擾感知效果提升的瓶頸問題。在此之下,感知大模型對超長尾場景的檢測能力更為精準,比如不規則障礙物、各種位置關系的行人、非機動車或是施工占道等等。

1.2 規劃

決策規劃部份,百度Apollo ADFM已經實作了 合規避障、賽局、預判 等基本能力,同時跳出了原有決策規劃任務中預測、決策、車道選擇等階段性任務,可以透過全鏈路模型化綜合輸出多元環境資訊,直接生成執行軌跡。

另外,這套規劃決策模型也將 人類駕駛員的駕駛數據 作為訓練數據,從行為擬人到超越人類駕駛,提升系統的安全性。

基於Apollo自動駕駛大模型 (Apollo ADFM),國內唯一的純視覺城市NOA產品ANP3將升級為ASD(Apollo Self-Driving),先發於極越全系車型,L2+將為L4反哺數據,進一步縮短驗證時間。

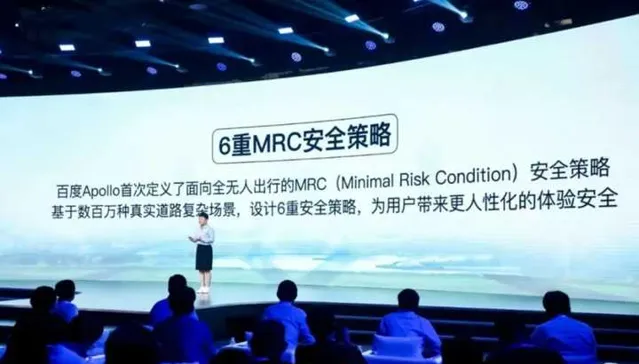

1.3 安全策略

據百度汽車機器人部總經理尹穎介紹,蘿蔔快跑第六代無人車全面套用了「百度Apollo ADFM大模型+硬體產品+安全架構」的方案,基於1億公裏的真實場景執行數據和數百萬種復雜場景的分析,為蘿蔔快跑第六代無人車設計了10重安全冗余和6重MRC (minimal risk condition) 安全策略,根據具體情況 逐級或跨級降級 ,以實作最安全、最人性化的安全表現。

比如,遇到大霧大雨等惡劣天氣條件時,系統會進行限速處理以保障順利出行;若乘客在車輛行駛過程中緊急情況嘗試開啟車門,車輛會緩慢剎車直到安全停車。

2 Waymo

2022年,Waymo發表了兩篇科學論文,將自動駕駛汽車的效能與人類駕駛進行了比較。第一篇分析了 碰撞即將發生時的反應時間 ,另一篇則 提出了一種新穎的方法來評估自動駕駛系統避免碰撞的能力 。

首先,Waymo統計了截至2023年10月所有Robotaxi的行駛裏程,共計超過714萬英裏。其中包括在 鳳凰城 的534萬英裏,在 舊金山 的176萬英裏,以及在 洛杉磯 的4.67萬英裏。而在這超714萬英裏的路程中,Waymo只發生了三起造成乘客受傷的嚴重碰撞事故,並且Waymo表示他們受的都是輕傷。

這些事故分別是:

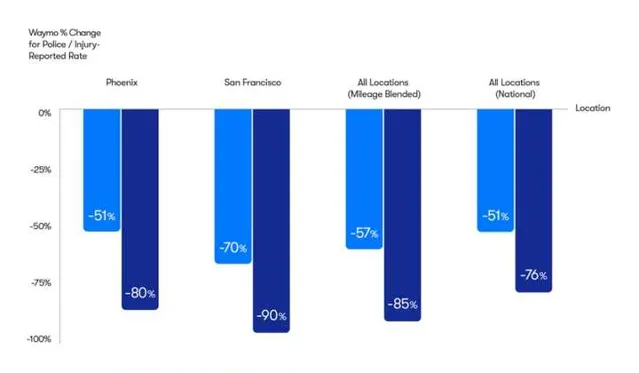

綜合這些數據,Waymo Robotaxi事故發生率為每百萬英裏 0.42起 。

對比人類司機每百萬英裏會發生 2.78起事故 ,Waymo認為,自己的自動駕駛系統能夠降低 85% 的事故發生機率。

據悉,Waymo已將這份研究報告送出至科學期刊進行同行評審,與此同時,已有學者對此研究表示肯定,對自動駕駛技術的安全性前景持有樂觀態度。

並且,為了更嚴謹的數據,Waymo還表示,需要修正一些影響因素。比如 城市 ,每個城市人類司機發生事故的頻率都不同;還有 行駛道路 ,Waymo的Robotaxi只會在城市道路上跑,並不會上高速,但統計人類司機行駛裏程時包括全部的道路環境;還有 隱瞞不報 的情況,有研究顯示,人類司機導致的傷害事故之中有 1/3 不會被統計報告。

在排除這些影響因素後,Waymo得出的結論是,Waymo Robotaxi在鳳凰城能降低 80% 的傷害事故發生機率,在舊金山能降低 90% 。(洛杉磯累計行程比較短,Waymo認為還不具有統計意義上的價值。)

除了這篇論文,Waymo還釋出了一篇詳細對比Waymo Robotaxi和人類司機事故碰撞率的論文,其實翻來覆去就是想說明一件事: 自動駕駛技術比人類司機更安全 。

值得一提的是,在Waymo釋出新報告的前一天,LendingTree亦公布了一份報告,指出特斯拉司機的事故發生率居高不下,這與特斯拉自身釋出的數據形成了鮮明對比。特斯拉的數據顯示,其Autopilot系統相較於人類駕駛者更為安全。

3 Cruise

相比之下Cruise就比較坎坷。

2023年8月11號,加州政府開放Robotaxi全天候營運。

2023年10月24日,加州DMV因為一場事故暫停了Cruise的無人駕駛授權證。之後Cruise解雇了九名高管,公司CEO凱爾·沃格特和公司聯合創始人、CPO丹·坎雙雙辭職。

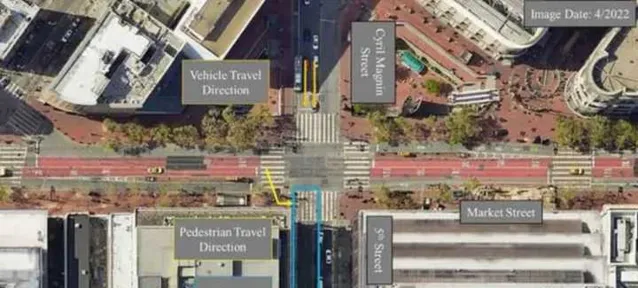

這場事故發生在2023年10月2日舊金山的一個十字路口,被Cruise稱為Panini的自動駕駛汽車撞到了 由人類駕駛車輛撞倒的行人 。Panini在檢測到撞擊後停下來,但錯誤地將事故歸類為側面碰撞,並啟動了靠邊停車操作,導致該女子夾在車輪之間,在11公裏/時的速度下被拖行了20英尺(約6.1公尺),造成了「多處嚴重受傷」。

事件分析大致如下,

在人類駕駛車輛和行人之間的首次碰撞之前,自動駕駛車輛準確地檢測、分類和跟蹤了行人和人駕駛車輛;其次,隨後車輛與行人的碰撞是由人駕駛車輛將個人發射到AV的行車路徑上造成的;第三,車輛錯誤地將與行人的碰撞歸類為側面碰撞,這導致車輛進行後續的靠邊移動操作(到最外側的車道),而不是緊急停車。此外,雖然不是停車後移動的主要原因,但未能辨識車輛已經在最外側車道是一個促成因素。

Cruise由於一場Robotaxi將行人卷入車底的車禍,被吊銷了無人駕駛營運和上路兩大授權。業務暫停的同時還面臨州政府高達150萬美元的罰款。

此前Cruise Robotaxi也發生過其他事故,只是情節相比較而言較輕。

比如8月17日晚10時左右,舊金山一輛Cruise的Robotaxi與一輛消防車相撞。

據Cruise在推特上釋出的官方訊息,車上的一名乘客受到了輕傷,被救護車送往醫院治療。Cruise聲明,當時Robotaxi「在綠燈時進入十字路口」,然後「被一輛消防車撞擊」。推文顯示,消防車當時正在前往緊急事故現場的途中。這表明Cruise的Robotaxi可能沒有讓行闖紅燈的消防車,導致事故發生。

2024年6月21日,據路透社訊息,加州監管機構6月20日宣布,由於通用汽車旗下的自動駕駛部門Cruise未能在規定時間內向該機構送出關於去年自動駕駛汽車事故的完整報告,將對其處以最高額度的罰款。此次罰款決定是在Cruise提出解決監管機構對其延遲披露行人事故細節調查的幾個月後作出的。

據監管機構透露,Cruise將面臨加州公用事業委員會(CPUC)規定的最高罰款,總額高達112,500美元。這意味著,在Cruise隱瞞事故資訊的15天裏,每天都需要支付7,500美元的罰款。此外,Cruise還被要求向CPUC和國家公路交通安全總署(NHTSA)送出有關加州碰撞事故的詳細報告。

盡管Cruise已於2024年4月在亞利桑那州鳳凰城恢復了營運,並部署了一小隊由人工駕駛的汽車,但其在加州使用自動駕駛汽車提供載客服務的許可權仍然被暫停。

文章更新記錄