先讲个老话题。

自动驾驶,机器驾驶比人类驾驶安全吗

[汽车智能驾驶] 系列文章请移步专栏:汽车智能驾驶 - 知乎 (zhihu.com)

初看萝卜快跑无人车

百度萝卜快跑引争议,为什么大家都在做Robotaxi

再看FSD,自动驾驶算法训练

再看L3——跳过L3,直接到L4?

再看L3上路通行试点,L3什么时候能正式上路?

为什么国内不能用FSD 第2话

如何看待自动驾驶车辆的shadow mode

自动驾驶,再看视觉路线和激光雷达路线

AI「涌现」,大模型与自动驾驶

2024年了,端到端的自动驾驶解决方案怎么样了

城市NOA与开城,2024自动驾驶首个必争之地

本文参考资料:

Waymo用数据为自动驾驶代言:比人类司机安全6.8倍,超1149万公里仅3起事故_腾讯新闻 (qq.com)

Cruise为何被吊销自驾运营执照,第三方调查报告揭秘 (baidu.com)

加州开放Robotaxi一周:Cruise连发三起事故,车队规模被减半 (baidu.com)

0 引言 机器驾驶是否比人类驾驶安全

关于机器驾驶是否比人类驾驶安全,其实其中因素很多。

当道路上机器驾驶车辆与人类驾驶车辆并存时,需要一段时间磨合的。近来众多关于萝卜快跑的讨论其实也是因此而生。

0.1 智能驾驶与行人

之前回答过:【行人与智能车是否能理解彼此的套路呢,行人走在智能车居多的道路上是否变得不安全了呢?】

这当然是相对的。问题可以rephrase为:自然人与机器驾驶的车辆相比,哪个对于行人更安全?

论反应速度和耐久,大部分人是比不过机器的,而且机器不会累,同样开了5小时的汽车,机器驾驶的车辆对于行人来说更安全。

论应对能力,不同自然人个体之间也是有差异的,机器的反应能力取决于算法,总体来说应该是能达到平均自然人的水平的。

但同时应对方式还取决于规则,比如关键时刻,如果车上没有乘客,是否能通过撞毁车来保护行人不受伤害,取决于算法。

0.2 智能驾驶与路上其他驾驶员

【智能机器与人的协作理解不如人与人的协作理解安全可靠吗?】

从理解彼此行为的角度上来说,个人觉得,在车辆相同的情况下,一辆机器驾驶的车辆和一辆人类驾驶的车辆互相理解彼此行为的程度,与两辆人类驾驶的车辆之间对于驾驶行为的理解程度,并不会有很大差异。

从沟通的角度来说,人类之间更容易沟通是因为对语气、语速、表情和动作等的熟悉,而机器人没有相关的特征。

但是车辆驾驶行为不存在驾驶员的切换而导致变化的特点。所以如果仅从理解彼此驾驶行为的角度,个人觉得一辆机器驾驶的车辆和一辆人类驾驶的车辆互相理解的难易程度与当前并不会有很大差异。

0.3 智能驾驶需要智慧交通

智慧交通是自动驾驶实施的必要条件。在自动驾驶充分成熟的时代,智慧交通应该也发展到相当程度,对道路上的车辆进行合理管控。

安全需要基础设施如摄像头物联网智慧交通的配合。

1 规范的成熟度。现在自动驾驶上市会有很多的法规分歧,比如事故责任分配等。

2 车路协同的成熟度。如果完全自动驾驶,所有车都自动驾驶,那安全的实现就依赖于车-车沟通和车-路沟通。

之前还回答过一个问题:

【自动驾驶能相信吗?】

完全自动驾驶的安全性不是相信自动驾驶还是相信人的问题,而是沟通与安全的问题。

如果路上人驾驶车辆居多,那自动驾驶车辆更危险。因为「人」对于自动驾驶车辆的驾驶逻辑是没有清楚概念的,同时「人」的驾驶具有更多随机性,自动驾驶车辆未必能完全应对得当。

如果路上都是自动驾驶的汽车,而你自动驾驶,那这辆车无疑比其他车更危险,因为对于「人」的行为的预判是最难的,而自动驾驶车辆相互之间能理解彼此套路。

0.4 机器驾驶与人类驾驶哪个更有优势

人类驾驶和机器驾驶各有各的优势。

个人觉得机器相比人的优势是不疲劳,反应速度快。但是决策是否最优的评判是很复杂的。这也是为什么要用视觉要用端对端要用大模型的原因,就是为了尽可能接近人的决策。

但这里边会逃不过这两点的讨论,

1)柯尔伯格道德两难论

如果一辆失控的卡车撞向火车还是撞上一群行人?

不同的人会做出不同的选择,那机器逻辑算法应该如何设定?

2)阿西莫夫机器人三大原则

第一定律。机器人不得伤害人类,或看到人类受到伤害而袖手旁观。

第二定律。机器人必须服从人类的命令,除非这条命令与第一定律相矛盾。

第三定律。机器人必须保护自己,除非这种保护与第一和第二定律相矛盾。

接下来我们看看几家比较大的智驾运营公司目前的情况。

1 百度

5月15日,百度在Apollo Day 2024发布了全球首个支持L4级自动驾驶的大模型Apollo ADFM(Autonomous Driving Foundation Model)。宣称安全性高于人类驾驶员10倍以上。

据称,百度Apollo ADFM基于大模型技术重构自动驾驶,可以兼顾技术的安全性和泛化性,实现城市级全域复杂场景覆盖。

截至2024年4月,百度Apollo的自动驾驶里程已经超过1亿公里,未发生过重大伤亡事故。同时,百度Apollo为每辆无人车及乘客购买了500万的保险,过去两年的数据显示,实际车辆出险率仅为人类司机的1/14。

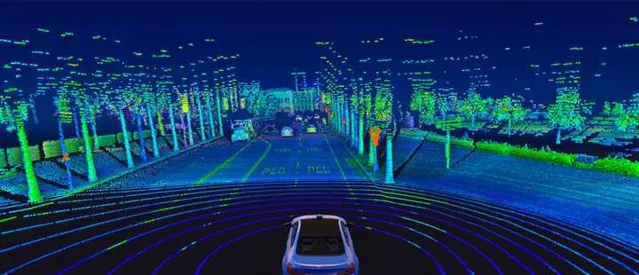

1.1 感知

Apollo ADFM感知大模型实现包括 检测、跟踪、理解、建图 这几项基本能力。

其中感知大模型中的基础模型通过 点云和视觉多模态融合 的方式,实现了相机和主动光不同类型传感器的优势互补,兼顾深度、准确性和信息丰富程度。

在数据处理上,实现了更完善的 数据自标注 ,将原始数据 批量自动化转化为粗标数据以及精标数据 ,极大程度的解决了标注数据获取这一困扰感知效果提升的瓶颈问题。在此之下,感知大模型对超长尾场景的检测能力更为精准,比如不规则障碍物、各种位置关系的行人、非机动车或是施工占道等等。

1.2 规划

决策规划部分,百度Apollo ADFM已经实现了 合规避障、博弈、预判 等基本能力,同时跳出了原有决策规划任务中预测、决策、车道选择等阶段性任务,可以通过全链路模型化综合输出多元环境信息,直接生成执行轨迹。

另外,这套规划决策模型也将 人类驾驶员的驾驶数据 作为训练数据,从行为拟人到超越人类驾驶,提升系统的安全性。

基于Apollo自动驾驶大模型 (Apollo ADFM),国内唯一的纯视觉城市NOA产品ANP3将升级为ASD(Apollo Self-Driving),首发于极越全系车型,L2+将为L4反哺数据,进一步缩短验证时间。

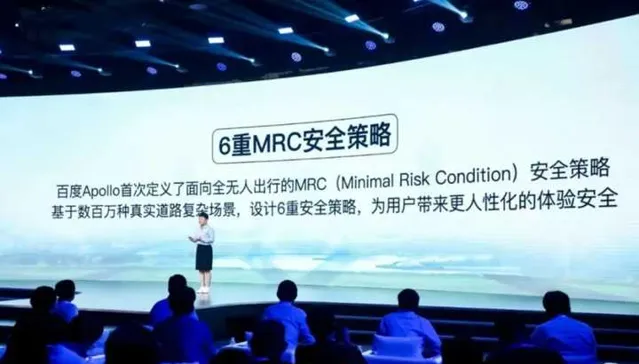

1.3 安全策略

据百度汽车机器人部总经理尹颖介绍,萝卜快跑第六代无人车全面应用了「百度Apollo ADFM大模型+硬件产品+安全架构」的方案,基于1亿公里的真实场景运行数据和数百万种复杂场景的分析,为萝卜快跑第六代无人车设计了10重安全冗余和6重MRC (minimal risk condition) 安全策略,根据具体情况 逐级或跨级降级 ,以实现最安全、最人性化的安全表现。

比如,遇到大雾大雨等恶劣天气条件时,系统会进行限速处理以保障顺利出行;若乘客在车辆行驶过程中紧急情况尝试打开车门,车辆会缓慢刹车直到安全停车。

2 Waymo

2022年,Waymo发表了两篇科学论文,将自动驾驶汽车的性能与人类驾驶进行了比较。第一篇分析了 碰撞即将发生时的反应时间 ,另一篇则 提出了一种新颖的方法来评估自动驾驶系统避免碰撞的能力 。

首先,Waymo统计了截至2023年10月所有Robotaxi的行驶里程,共计超过714万英里。其中包括在 凤凰城 的534万英里,在 旧金山 的176万英里,以及在 洛杉矶 的4.67万英里。而在这超714万英里的路程中,Waymo只发生了三起造成乘客受伤的严重碰撞事故,并且Waymo表示他们受的都是轻伤。

这些事故分别是:

综合这些数据,Waymo Robotaxi事故发生率为每百万英里 0.42起 。

对比人类司机每百万英里会发生 2.78起事故 ,Waymo认为,自己的自动驾驶系统能够降低 85% 的事故发生概率。

据悉,Waymo已将这份研究报告提交至科学期刊进行同行评审,与此同时,已有学者对此研究表示肯定,对自动驾驶技术的安全性前景持有乐观态度。

并且,为了更严谨的数据,Waymo还表示,需要修正一些影响因素。比如 城市 ,每个城市人类司机发生事故的频率都不同;还有 行驶道路 ,Waymo的Robotaxi只会在城市道路上跑,并不会上高速,但统计人类司机行驶里程时包括全部的道路环境;还有 隐瞒不报 的情况,有研究显示,人类司机导致的伤害事故之中有 1/3 不会被统计报告。

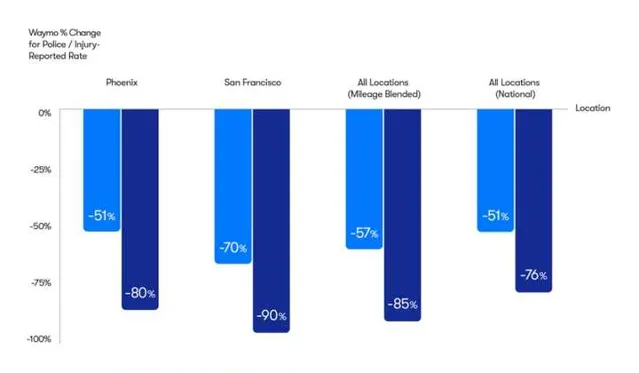

在排除这些影响因素后,Waymo得出的结论是,Waymo Robotaxi在凤凰城能降低 80% 的伤害事故发生概率,在旧金山能降低 90% 。(洛杉矶累计行程比较短,Waymo认为还不具有统计意义上的价值。)

除了这篇论文,Waymo还发布了一篇详细对比Waymo Robotaxi和人类司机事故碰撞率的论文,其实翻来覆去就是想说明一件事: 自动驾驶技术比人类司机更安全 。

值得一提的是,在Waymo发布新报告的前一天,LendingTree亦公布了一份报告,指出特斯拉司机的事故发生率居高不下,这与特斯拉自身发布的数据形成了鲜明对比。特斯拉的数据显示,其Autopilot系统相较于人类驾驶者更为安全。

3 Cruise

相比之下Cruise就比较坎坷。

2023年8月11号,加州政府开放Robotaxi全天候运营。

2023年10月24日,加州DMV因为一场事故暂停了Cruise的无人驾驶许可证。之后Cruise解雇了九名高管,公司CEO凯尔·沃格特和公司联合创始人、CPO丹·坎双双辞职。

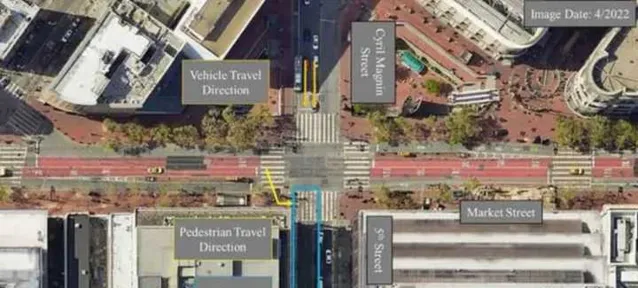

这场事故发生在2023年10月2日旧金山的一个十字路口,被Cruise称为Panini的自动驾驶汽车撞到了 由人类驾驶车辆撞倒的行人 。Panini在检测到撞击后停下来,但错误地将事故归类为侧面碰撞,并启动了靠边停车操作,导致该女子夹在车轮之间,在11公里/时的速度下被拖行了20英尺(约6.1米),造成了「多处严重受伤」。

事件分析大致如下,

在人类驾驶车辆和行人之间的首次碰撞之前,自动驾驶车辆准确地检测、分类和跟踪了行人和人驾驶车辆;其次,随后车辆与行人的碰撞是由人驾驶车辆将个人发射到AV的行车路径上造成的;第三,车辆错误地将与行人的碰撞归类为侧面碰撞,这导致车辆进行后续的靠边移动操作(到最外侧的车道),而不是紧急停车。此外,虽然不是停车后移动的主要原因,但未能识别车辆已经在最外侧车道是一个促成因素。

Cruise由于一场Robotaxi将行人卷入车底的车祸,被吊销了无人驾驶营运和上路两大许可。业务暂停的同时还面临州政府高达150万美元的罚款。

此前Cruise Robotaxi也发生过其他事故,只是情节相比较而言较轻。

比如8月17日晚10时左右,旧金山一辆Cruise的Robotaxi与一辆消防车相撞。

据Cruise在推特上发布的官方消息,车上的一名乘客受到了轻伤,被救护车送往医院治疗。Cruise声明,当时Robotaxi「在绿灯时进入十字路口」,然后「被一辆消防车撞击」。推文显示,消防车当时正在前往紧急事故现场的途中。这表明Cruise的Robotaxi可能没有让行闯红灯的消防车,导致事故发生。

2024年6月21日,据路透社消息,加州监管机构6月20日宣布,由于通用汽车旗下的自动驾驶部门Cruise未能在规定时间内向该机构提交关于去年自动驾驶汽车事故的完整报告,将对其处以最高额度的罚款。此次罚款决定是在Cruise提出解决监管机构对其延迟披露行人事故细节调查的几个月后作出的。

据监管机构透露,Cruise将面临加州公用事业委员会(CPUC)规定的最高罚款,总额高达112,500美元。这意味着,在Cruise隐瞒事故信息的15天里,每天都需要支付7,500美元的罚款。此外,Cruise还被要求向CPUC和国家公路交通安全管理局(NHTSA)提交有关加州碰撞事故的详细报告。

尽管Cruise已于2024年4月在亚利桑那州凤凰城恢复了运营,并部署了一小队由人工驾驶的汽车,但其在加州使用自动驾驶汽车提供载客服务的权限仍然被暂停。

文章更新记录