在這個問題下,竟然沒有人說大名鼎鼎的 KinectFusion以及他後面的一系列工作? KinectFusion單篇論文參照都已經超過3000次了,不應該啊!

如果只想看現階段效果最好的三維重建演算法,請拉到文章最後(如有更好的演算法,還請告知)。

一、KinectFusion

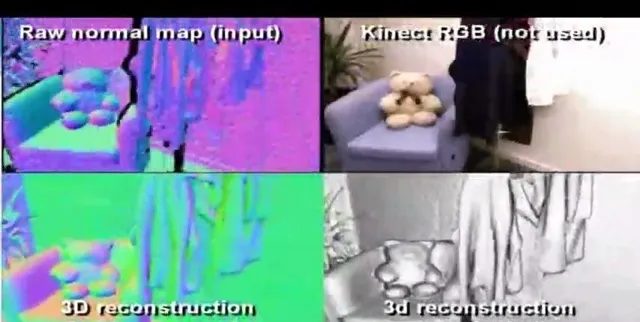

帝國理工的Newcombe等人在2011年提出的 KinectFusion, 可在不需要RGB圖而只用深度圖的情況下就能即時地建立三維模型。KinectFusion演算法首次實作了基於廉價消費類相機的即時剛體重建,在當時是非常有影響力的工作,它極大的推動了即時稠密三維重建的商業化行程。

在他們的論文中沒有開原始碼,最初的程式碼是由PCL團隊實作的:kinectfusion-open-source

KinectFusion的重建效果可以看這個視訊:

KinectFusion重建效果

https://www.zhihu.com/video/1184501699569471488

KinectFusion重建效果

https://www.zhihu.com/video/1184501699569471488

KinectFusion之後,陸續出現了 Kintinuous,ElasticFusion,ElasticReconstruction,DynamicFusion,InfiniTAM,BundleFusion 等非常優秀的工作。其中2017年史丹佛大學提出的 BundleFusion 演算法,據說是目前基於RGB-D相機進行稠密三維重建效果最好的方法。

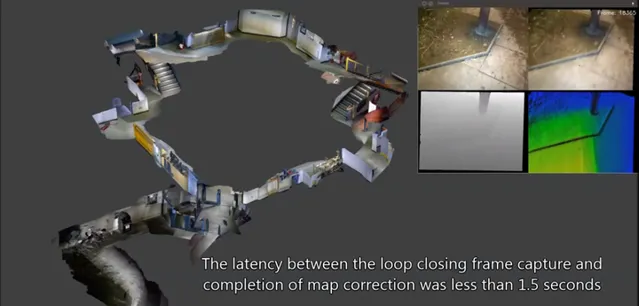

二、Kintinuous和ElasticFusion

這兩個工作都是同一個人做出來的,這個人就是 Thomas Whelan。 這兩個工作應該算KinectFusion之後影響力比較大的。

Kintinuous GitHub程式碼:mp3guy/Kintinuous

ElasticFusion GitHub程式碼:mp3guy/ElasticFusion

Kintinuous2.0重建效果:

ElasticFusion 重建效果:

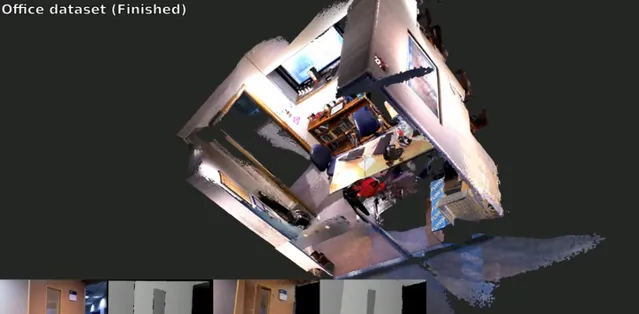

三、ElasticReconstruction

計畫官網:http:// qianyi.info/scene.html

GitHub程式碼:qianyizh/ElasticReconstruction

重建效果:

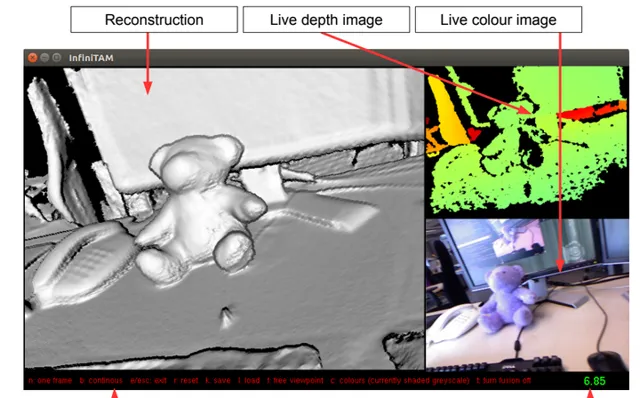

四、InfiniTAM

InfiniTAM提供 Linux,iOS,Android平台版本,CPU可以即時重建 。

官網 : InfiniTAM v3

GitHub程式碼:victorprad/InfiniTAM

重建效果:

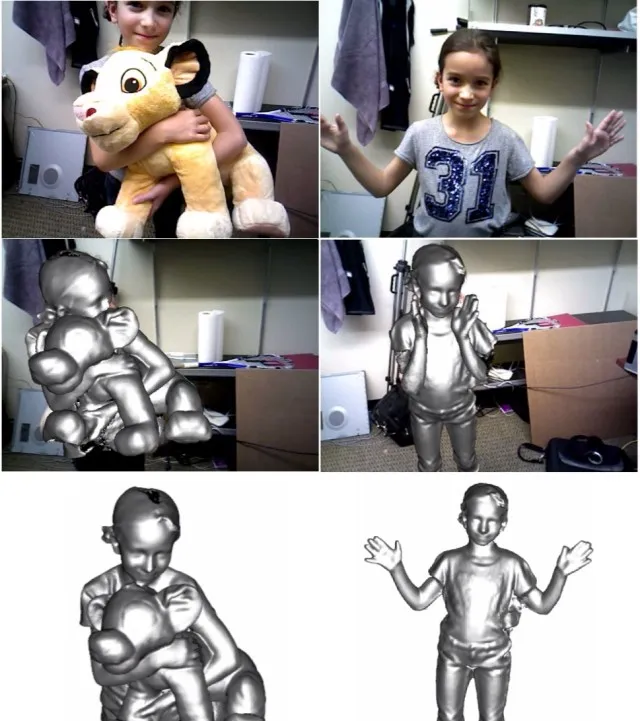

五、DynamicFusion

官網: DynamicFusion Project Page

程式碼: https:// github.com/mihaibujanca /dynamicfusion

重建效果:

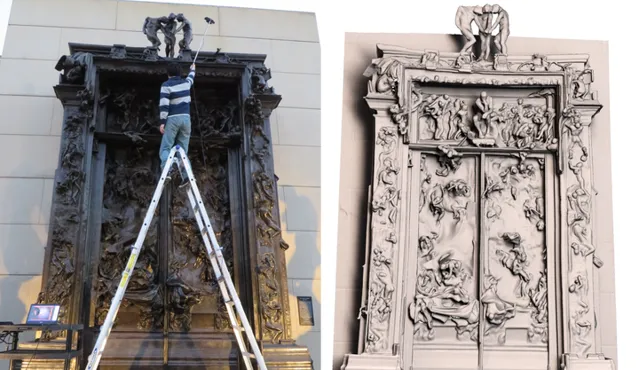

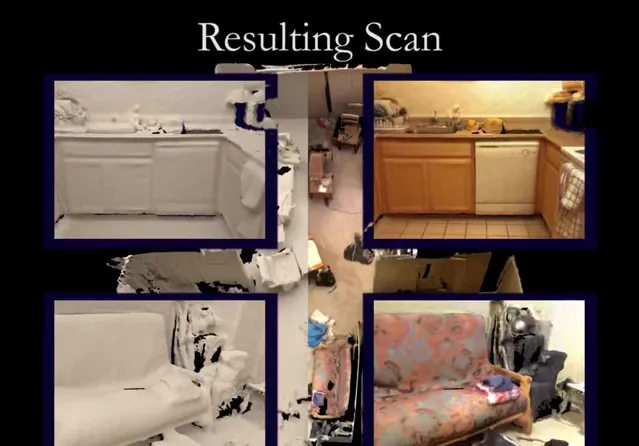

六、BundleFusion

據說是現在重建效果最好的工作!

官網: BundleFusion

論文:https:// arxiv.org/pdf/1604.0109 3.pdf

程式碼:niessner/BundleFusion

演算法解讀:電腦視覺方向簡介 | 深度相機室內即時稠密三維重建

重建效果:

BundleFusion:最好的三維重建

https://www.zhihu.com/video/1184509281717673984

BundleFusion:最好的三維重建

https://www.zhihu.com/video/1184509281717673984

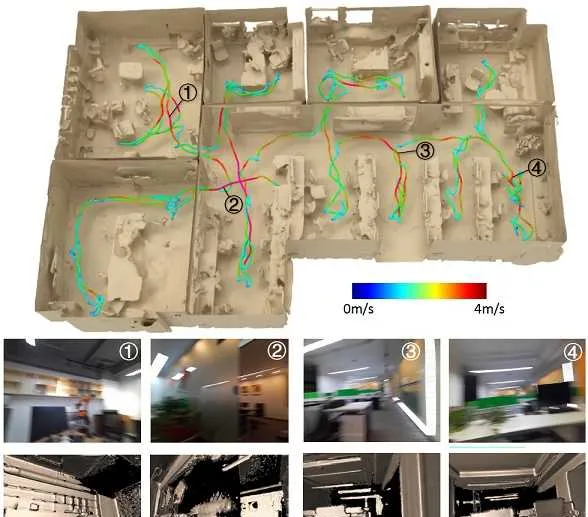

最近國防科大張博士也發表了一篇稠密三維重建的文章 (ROSEFusion)。僅依靠深度圖作為輸入,利用隨機最佳化實作了快速相機下的稠密重建。程式碼已經開源https:// github.com/jzhzhang/ROS EFusion

ROSEFusion 能夠在僅考慮深度圖作為輸入的條件下,利用隨機最佳化求解相機位姿,實作了在快速相機移動下的室內場景稠密重建。同時該工作僅依賴深度資訊,因此也可以在無光照,和變化光照的條件下使用。 該工作的主要特點是:(a) 利用深度圖和TSDF相容性作為代價函式,不需要提取特征點,僅依賴於深度圖;(b) 提出了Particle Swarm Template(PST),利用PST可以高效的對相機位姿空間進行采樣,並利用隨機最佳化求解出相機的位姿。

傾情整理,建議收藏。

如果能點贊就更好。