自動駕駛基座模型

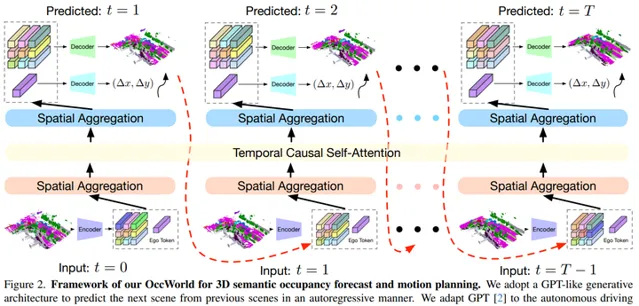

自動駕駛的GPT模式大規模預訓練方法。自動駕駛最大的痛點:數據需求量太大,標註成本太高。如果能像GPT那樣先透過大規模無監督預訓練獲得智慧,然後標註少量數據微調,那該多好啊!這個東西有時候叫World Model ,有時候叫Foundation Model,比較雜。但總歸是這麽個意思,就是復制ChatGPT的成功。

現在的狀態:

仍然不令人滿意,主要是數據太少,像樣的車企都是幾百上千萬的視訊,公開數據集的數據根本沒法看。缺乏數據,訓練這樣的模型只能大概看個樣子。其次預訓練任務也可以再改改,學一下柏克萊LVM的做法。

但真正的突破應該不會來自科研機構,只會來自掌握數據的車企,或者誰來建立個大數據集引領一下。我仍然相信特斯拉,現在這個方向基本等於明盤了,堆數據堆算力即可。

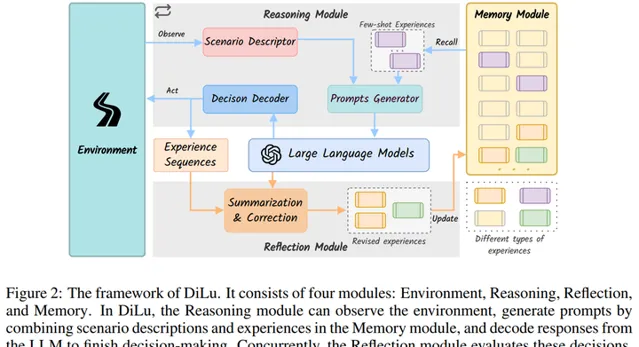

有LLM參與的自動駕駛

參與方式很多,現在是各方向全面開花的狀態。現在的狀態:

這個框架,可以說非常完美了。之前我還對那個memory module頗有微詞,覺得這屬於作弊。現在我已經改變看法了,記憶模組沒有任何問題,人不也是靠記憶開車?到了某個場景,人會回憶老師教過的一套行為模式操作。楊樂昆的世界模型裏也有記憶模組,如果記憶模組能解決問題,那就記吧!

要真正跑起來,還需要去nuPlan之類的數據集上測,然後把LLM小型化。明年應該可以!

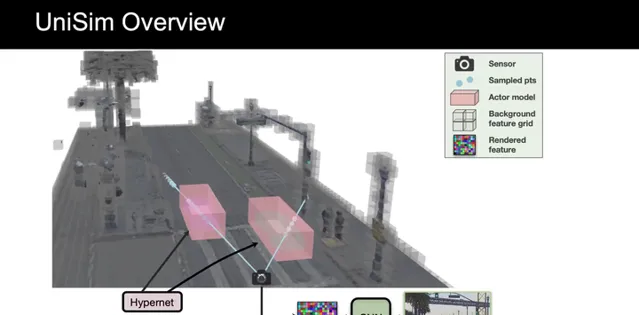

基於NeRF的自動駕駛閉環仿真

通向自動駕駛的最後一公裏:閉環仿真。用於訓練RL是必須的,前面某回答裏我說強化學習最大瓶頸就是仿真器,只要能仿真,強化學習一定秒殺人類。而使用遊戲引擎渲染場景則面臨人工建模太貴,虛擬和現實有gap等問題,已經是死路一條。NeRF是出路,現在的狀態:

看起來挺厲害,但NeRF仍然存在無法撬動現實世界常識的問題。有沒有所謂大規模預訓練的NeRF?能讓NeRF有一些先驗的常識,哪怕他產生幻覺,也不至於想象出一些不符合常理的shi…

所以要解決閉環仿真問題一定要有一個比較好的NeRF,現在最好的NeRF也很一般,明年這方面應該會有大突破!