AI 绘画除了画图发圈以后,应用的场景还是比较多的!我们就以 SD 来举例吧。

修复老照片,用到了ControlNet 中的 Recolor 预处理器。

Recolor 需要额外下载模型,模型已经给小伙伴们放在网盘里了,模型网站无法下载的小伙伴可以直接从网盘获取哦。

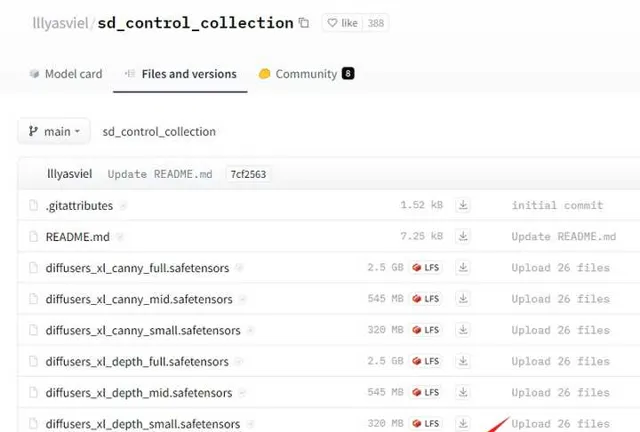

模型网站下载地址:https:// huggingface.co/lllyasvi el/sd_control_collection/tree/main网盘下载地址:https:// pan.quark.cn/s/df5c2e82 644c

模型网站进来以后选择我们需要的模型「ioclab_sd15_recolor.safetensors」,点击下载按钮进行下载。

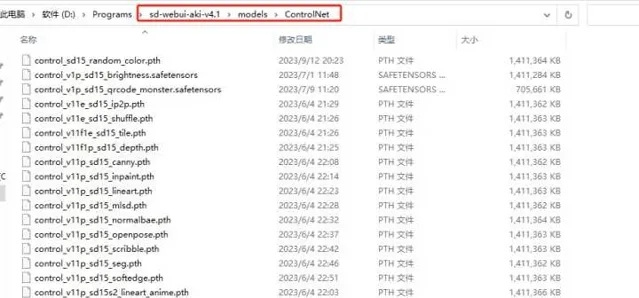

模型下载完成以后,把模型放到 SD 的指定目录文件夹下:

\sd-webui-aki-v4.1\models\ControlNet

然后我们上传一张需要上色的黑白老照片,点击启用和完美像素模式,点击控制类型 Recolor,如果模型没有加载进来,记得点下模型旁边的刷新按钮。预处理器有两种,小伙伴们都可以试试。

然后我们选择一个真人大模型,如果只是上色,提示词可以不用写,直接点击生成就可以完成上色了,当然我们也可以在提示词上指定我们想要修复的颜色。

以下就是黑白老照片修复的彩色照片了,分别使用了 Recolor 的两种预处理器,小伙伴们可以看下效果。对于退色的老照片而言,又重换新生了有么有?

还可以一键生成自己的专属艺术照,用到了 EasyPhoto 插件。

老样子,先安装插件,插件名「EasyPhoto」,需要在扩展中从网址安装,输入插件的地址:https:// github.com/aigc-apps/sd -webui-EasyPhoto ,然后点击安装重启 SD 。

安装完成以后就可以在 SD 的界面上看到「EasyPhoto」的目录了。

EasyPhoto 需要依赖 ControlNet 插件,所以没有安装 ControlNet 的小伙伴记得安装下 ControlNet 插件,然后去 SD 的设置界面找到 ControlNet ,设置 ControlNet Unit 的最大数量要大于 3 。

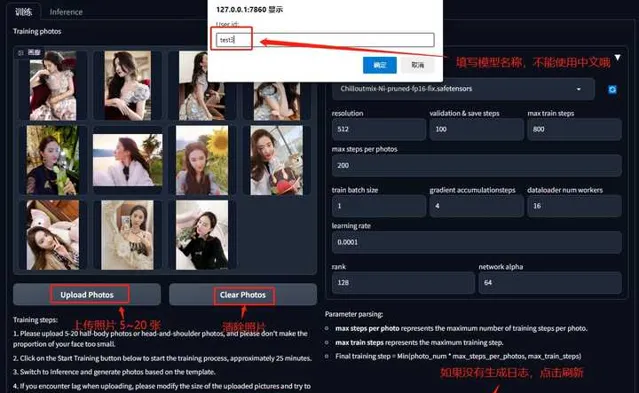

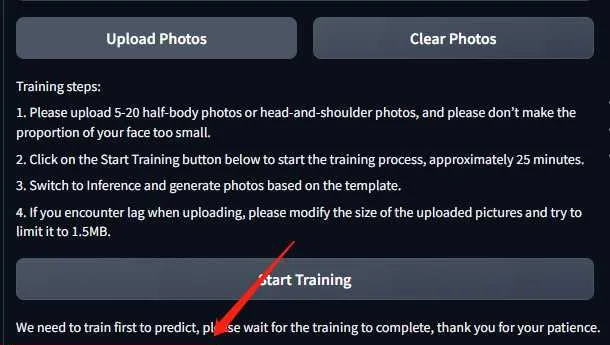

回到 EasyPhoto 的界面,选择「训练」,点击上传照片, 这里最好上传 5 到 20 张照片,包括不同的角度和光照 , 最好是半身照 。如果不想生成戴眼镜的照片,那就不要上传戴眼镜的照片或者比例低一些。

右边的参数大家选默认就好了,如果需要调整,可以看下边图中的各个参数介绍。

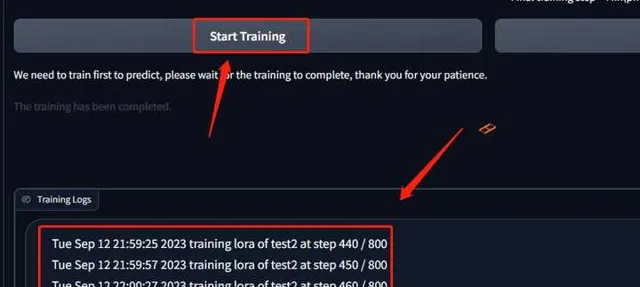

然后我们点击「Start Training」,并且填写训练模型名称以后,就可以看到下边的日志,训练已经开始了,第一次训练的时候需要下载一些模型和依赖库,会慢一点,小伙伴们要有耐心哦。接下来的每次训练官方宣传是 25 分钟一次,听雨试下来基本要半个小时的样子。当然主要也看我们的电脑配置。

展示以下红框中的信息则代表训练完成了。

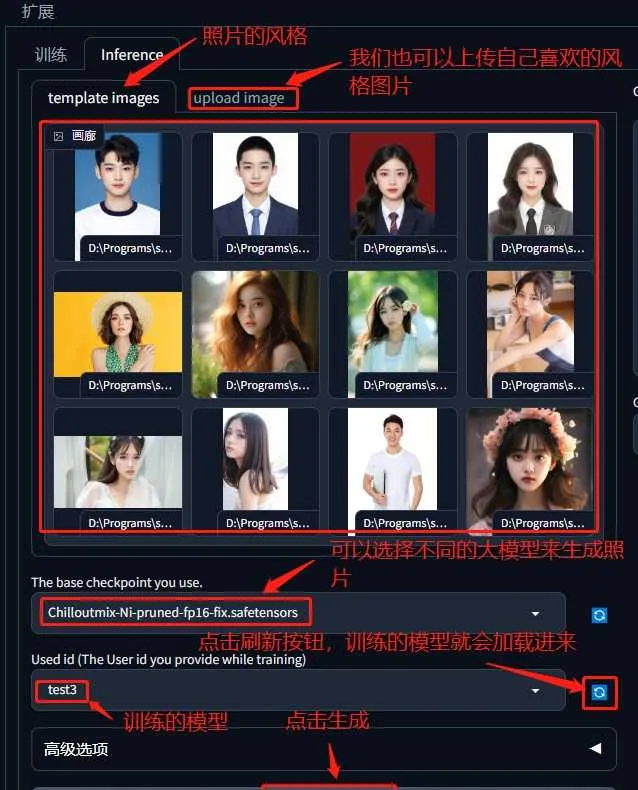

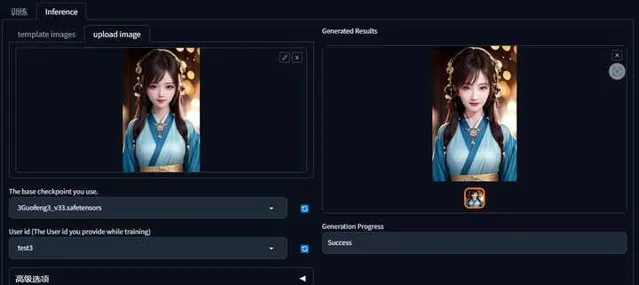

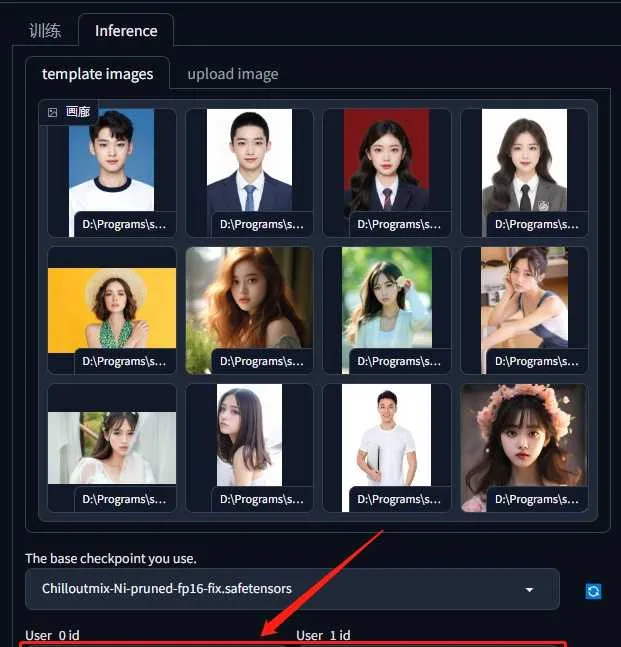

接下来我们就可以进入「Inference」中来生成我们想要的照片啦,可以在画廊中选择自己想要的风格,然后选择大模型,再选择我们训练好的模型,高级选项参数默认,然后点击「Start Generation」开始生成。

模型尽量选偏真人的模型哦,我们随便选一个风格生成看下效果,效果很可以哦。

我们上传一张自己想要的风格图片来生成一下看看效果,是不是也很 nice 。

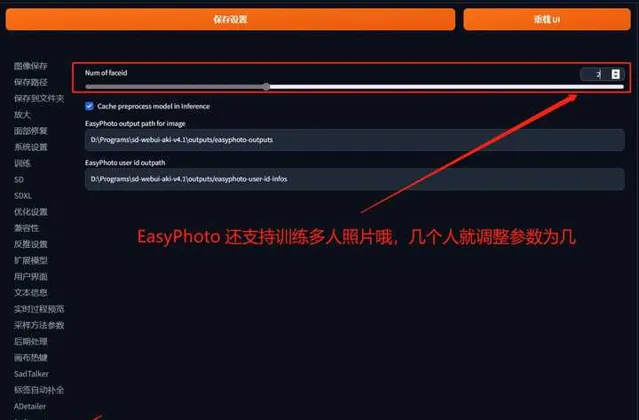

EasyPhoto 还支持生成多人模板哦,在 SD 的设置中找到 EasyPhoto ,然后修改 「Num of Faceid」,你想要生成几个人的照片就设置成几,比如我们需要生成 2 个人的模板照片,那就设置成 2 。

多人模板和单人模板的训练是一样的,需要单独给每个人训练模型,然后在「upload image」中上传我们的多人照片模板,EasyPhoto 本身是没有提供多人照片模板,所以需要我们自己上传。

可以看到「Inference」中的训练模型可以选择两个训练模型了,如果「Num of Faceid」设置为 3,那这里就可以选择三个模型。

接下来的操作就和单人一样了,选择对应的训练模型,点击生成就可以了。当然我们也可以只选「User_0_id」,「User_1_id」不选默认为 none ,这样就生成只会替换你多人模板中的左边的人物的脸。

还可以用于模特换装,用到了插件 segment-anything。

首先安装插件「segment-anything」,在 SD 扩展中搜索「segment-anything」,点击安装,重启 SD 。

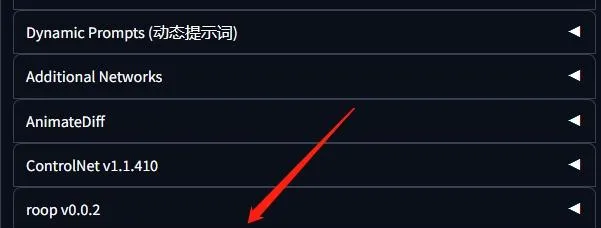

在 SD 的界面中出现这个选项就说明安装成功了。

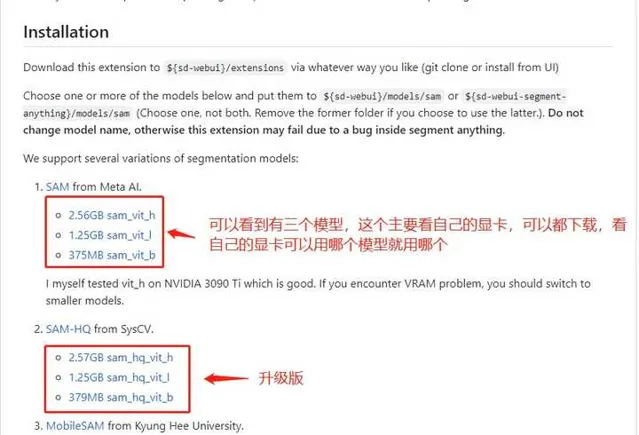

该插件还需要安装模型,可以去官网「https:// github.com/continue-rev olution/sd-webui-segment-anything 」的「Installation」部分下载模型。三个模型主要看显卡的显存大小,听雨是 12G 的显存,所以可以用最高档,也就是「_h」结尾的模型。

模型也已经给小伙伴们整理在网盘里了:

网盘链接:https:// pan.quark.cn/s/d8ee333d c224

模型下载完以后放到以下文件夹目录下:

\sd-webui-aki-v4.1\extensions\sd-webui-segment-anything\models\sam

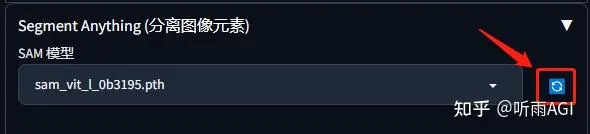

然后进入 segment-anything 的插件界面,点击模型刷新按钮,加载模型。

选择好模型以后,我们上传一张图片,比如我们想要提取人物眼睛的部分,我们只需要鼠标左键点击眼睛,可以看到鼠标左键点击以后,会在点击区域形成一个黑点。

然后我们点击预览分解结果可以看到识别的已经很精确了,但是还是可以看到鼻子上还有点瑕疵。

基于以上的瑕疵,我们就在鼻子上的有瑕疵的位置用鼠标右键点击,会生成红色的小点,这个红色小点就代表不想提示的部分。

我们再试一下可以看到很完美了。可以准确提取眼睛的蒙版图。

有时候使用这种标记也很难提取出我们想要的元素怎么办,蒙版里总是会有一些东西乱入。

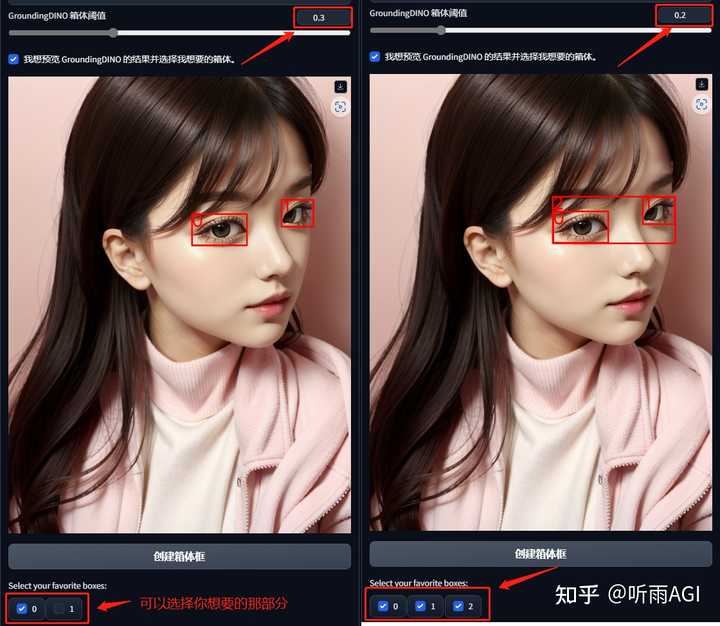

我们可以尝试启用「GroundingDINO」,这个功能是实现语义分割,就是我们只要输入提示词,比如我们想要提取眼睛的蒙版,我们只需要输入提示词「eyes」就可以了。

我们可以看到还有一个参数叫做箱体阈值,这个值主要是相同的提示词可以提取出的元素的数量,值越小可以提取出的元素块越多,值越大可以提取出的元素块越少。

我们可以看到截图底部存在箱体的编号,我们可以全部勾选,也可以只勾选我们想要的箱体。

比如我们只需要提取左边的眼睛,那我们只需要勾选 0 就可以了,然后我们点击预览分离结果,可以看到只提取了左边的眼睛。

小伙伴们可能要问了,说好的商业换装呢,在哪呢?

别急呀,这不就来了么!

接下来我们来具体操作下蒙版的使用场景,比如商业换装场景,但是不限于商业换装一种场景哈。

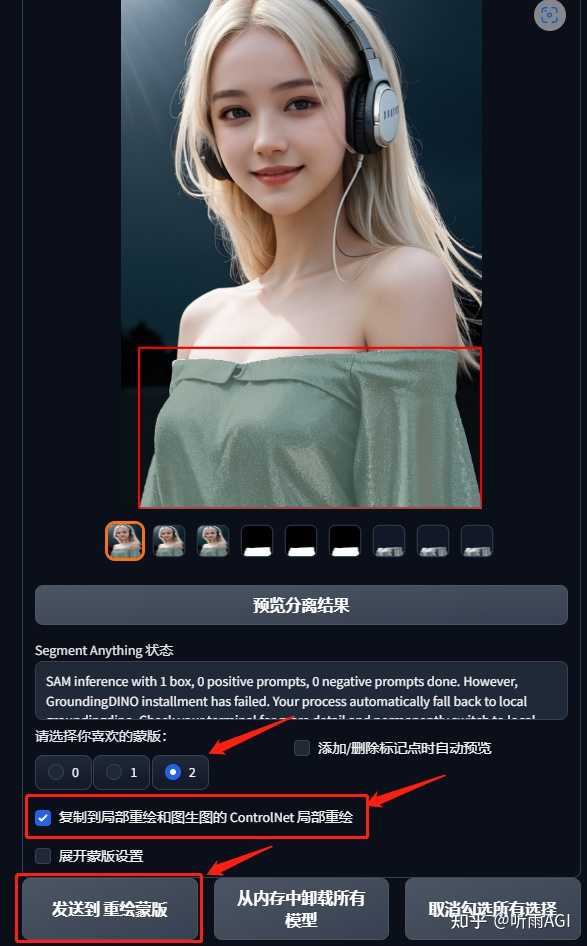

我们把下边的小姐姐想象成一个假人模型哈,我们要把假人模特上的衣服换到一个真人上,这里我们点击生成蒙版以后,选择对应的3个蒙版中我们自己比较中意的一个模版,勾选复制到局部重绘和图生图的 ControNet 局部重绘,然后点击发送到重绘模版。

我们往上翻可以看到已经自动进入了上传重绘蒙版选框中,这里边是看不到图片的,实际是已经存在了,接下来我们把蒙版模式改为重绘非蒙版内容,重绘区域选择仅蒙版区域。

然后修改我们的提示词或者模型,点击生成。可以看到,衣服完美的替换到了另一个小姐姐的身上。

有做服装电商的小伙伴,是不是只需要用假人模型拍个衣服的照片,用这种方式就有无数的真人模特了有么有。还不快用起来!

如果用以上这种方式报错了,那我们就手动把图片和蒙版上传到上传重绘蒙版对应的位置就可以了

以上就是这个插件在服装电商领域的应用,其他的应用场景,由于篇幅有限,我们找个时间再讲哈!

还可以用来尝试不同的装修风格,使用了 ControlNet 的 IP-Adapter 控制类型。

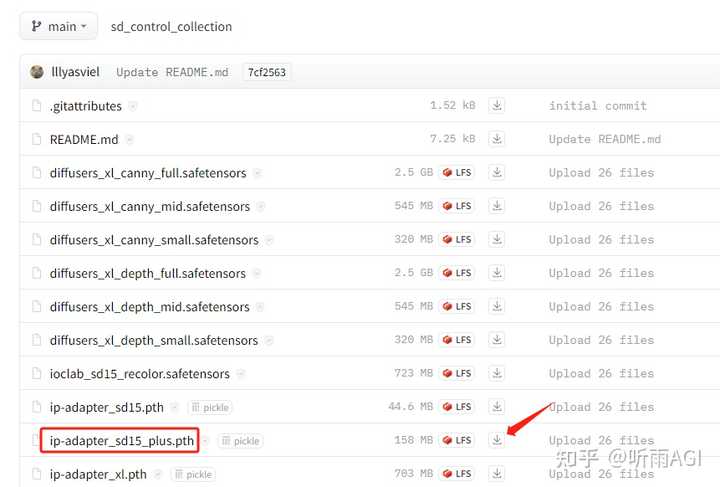

首先需要把 ControlNet 更新到最新版本。然后需要下载 IP-Adapter 的模型,可以去 huggingface下载,听雨也给小伙伴放网盘里了,小伙伴们也可以直接从网盘下载。

模型网站下载地址:https:// huggingface.co/lllyasvi el/sd_control_collection/tree/main网盘下载地址:https:// pan.quark.cn/s/df5c2e82 644c

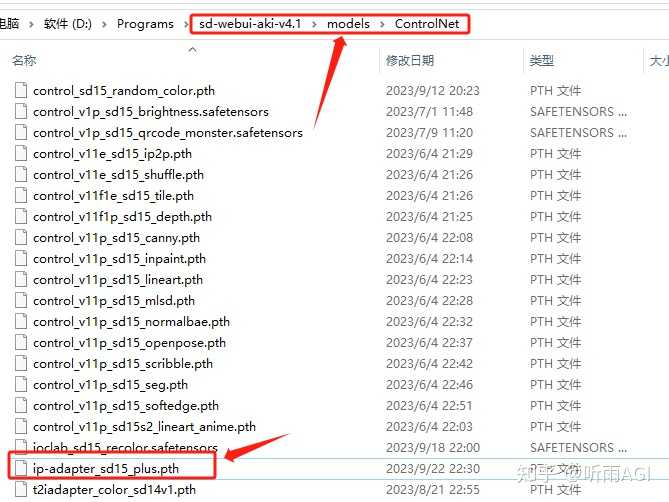

下载好的模型放入以下目录:

\sd-webui-aki-v4.1\models\ControlNet

更新成功以后,就可以看到 IP-Adapter 了,我们选择 sd15 的预处理,点击爆炸按钮会自动下载预处理器。

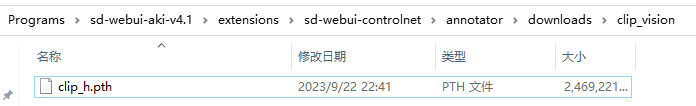

如果下载报错的话,网盘中听雨已经给小伙伴们下好了。

复制到以下目录就可以了。

\sd-webui-aki-v4.1\extensions\sd-webui-controlnet\annotator\downloads\clip_vision

接下来我们就开始正式的来看下 IP-Adapter 怎么使用。

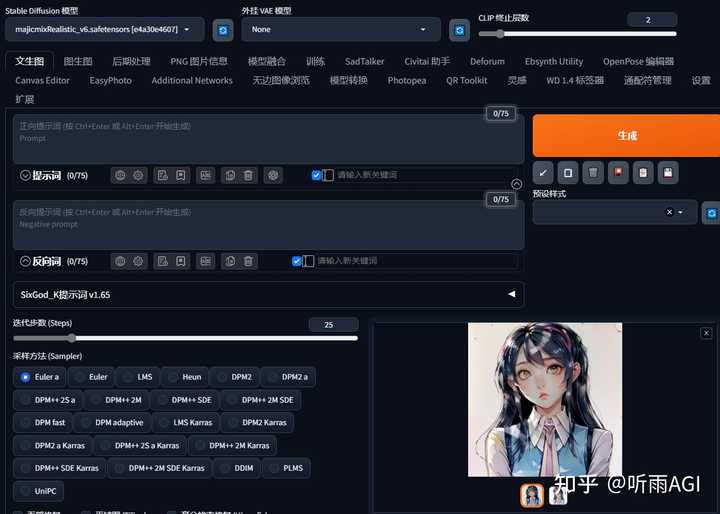

选中 IP-Adapter 控制器,一般预处理器和模型会默认加载,没加载的话,点一下模型旁边的刷新按钮,再没有的话,就需要看下模型是否放入指定目录下了。

点击启用、完美像素模式、允许预览,上传我们希望复制风格的图片,点击爆炸按钮。

选择一个我们想要的大模型,听雨这里主要是演示,就不写提示了,我们直接点击生成,可以看到生成的图像和我们的原图基本是一致的。

这是 IP-Adapter 最基本的用法,它还可以配合其他的控制类型组合使用,比如和 Canny 配合使用。IP-Adapter 保留风格,Canny 保留姿势。组合生成自己想要的图片。

再添加一个 ControlNet ,控制器选择 Canny,上传我们想要的人物姿势图,控制权重小于 1,听雨这里设置的是 0.8,然后我们点击生成。

可以看到风格和人物姿势融合到了一张图里了。

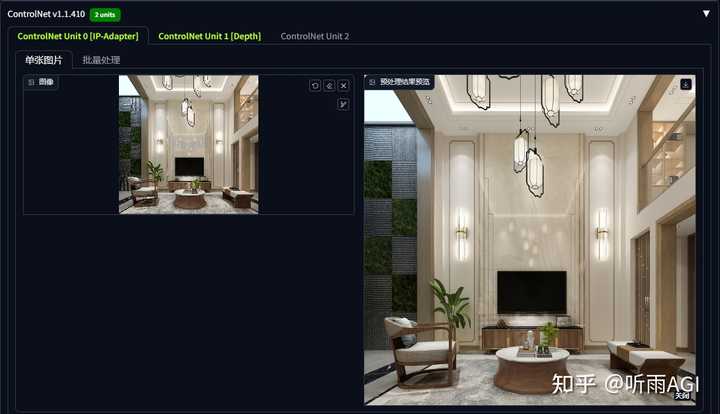

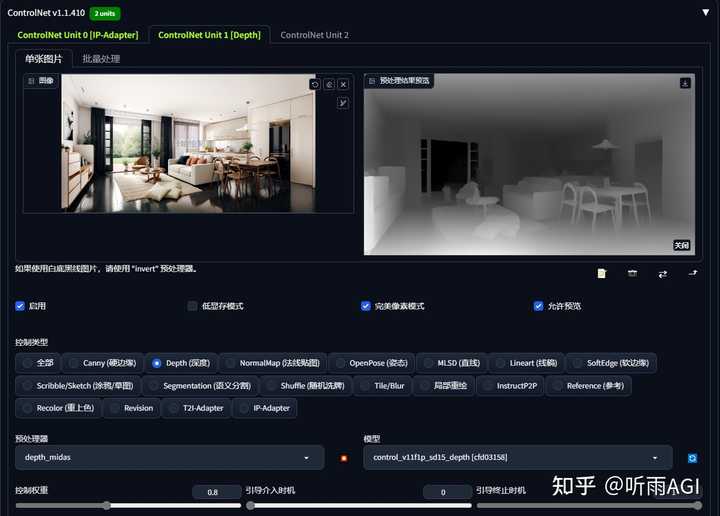

IP-Adapter 还可以和 Depth 组合使用。用来尝试不同的装修风格。

IP-Adapter 中上传我们想要的风格图片。

Depth 中上传我们房间的布局图片,预处理器和模型使用 Depth 默认的就行,然后记得点爆炸按钮,控制权重设置小于 1。

最后点击生成。图一的风格完美的融入了图二的装修布局上有么有。想换什么风格换什么风格。总能找到一款我们喜欢的。

还可以用 ADetailer 来生成表情包。

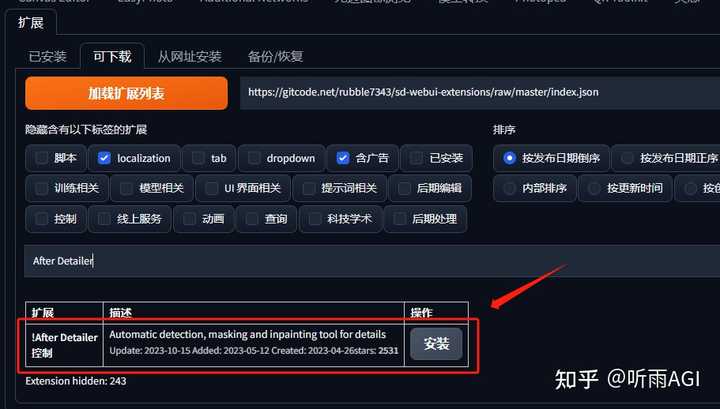

SD 的插件扩展中搜索「After Detailer」,点击安装,重启 SD 。

SD 界面上有以下这个选项就算是安装成功了。

插件的基础使用方法也很简单,点击启用,选择对应的模型就可以了。

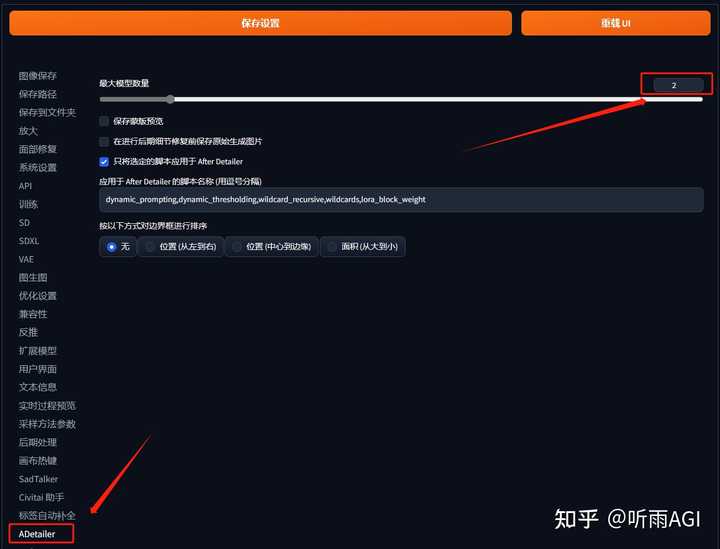

我们可以看到插件有「单元1」「单元2」,如果不够,我们还可以去设置里找到「ADetailer」选项中修改单元数量。各个单元之间可以组合使用哦,比如单元1修脸,单元2修手,以此类推。

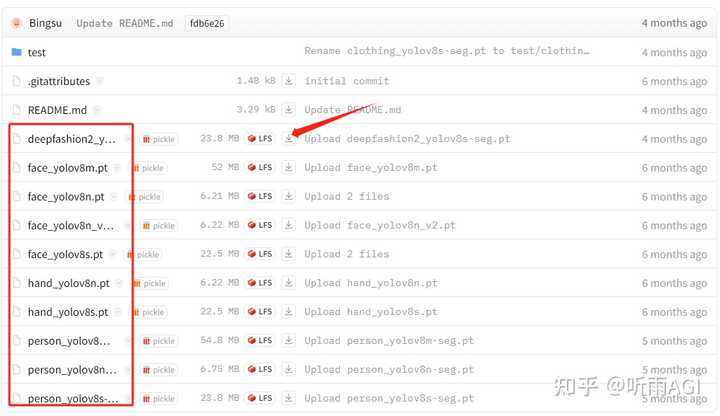

我们先来简单介绍下 ADetailer 的模型,如果小伙伴们安装插件以后没有模型,可以去huggingface下载,或者在网盘下载:

模型链接:https:// huggingface.co/Bingsu/a detailer/tree/main网盘链接:https:// pan.quark.cn/s/0167c820 9384

然后把模型下载复制到以下路径下

\sd-webui-aki-v4.1\models\adetailer

加上插件自带的模型,有以下这么多模型,我们咋用嘞。可以看到几个重复的单词「yolov:二次元」「mediapipe:真人」「face:脸」「hand:手」「person:全身」。以上几个单词搞懂了,以下的模型我们基本就都知道咋用了。

接下来我们随机生成一张图片。可以看到脸崩了,然后我们再启用 ADetailer 插件,选择真人脸部修复「mediapipe_face_full」,可以看到不仅修复了,脸部还给你加了细节有么有,是不是比面部修复好使多了。

再看下这个插件的界面,我们可以看到 ADetailer 插件是可以填写提示词的,这里你可以填写一些增加面部细节的提示词,有奇效哦!

然后今天不是还有一个生成表情包的功能没讲嘛,没错,这里就可以用来输入你的表情提示词。在不改变人物的情况下,修改人物的表情。

听雨这里修改了三种表情,分别在原图的基础上生成了 3 张新的图片,可以看到人物除了表情,其他基本没有变化。是不是可以生成一个系列的表情包了!这里需要注意下哦,要先固定随机种子哦!

AI 绘画的应用场景还有很多,以后慢慢补充。