AI 繪畫除了畫圖發圈以後,套用的場景還是比較多的!我們就以 SD 來舉例吧。

修復老照片,用到了ControlNet 中的 Recolor 預處理器。

Recolor 需要額外下載模型,模型已經給小夥伴們放在網盤裏了,模型網站無法下載的小夥伴可以直接從網盤獲取哦。

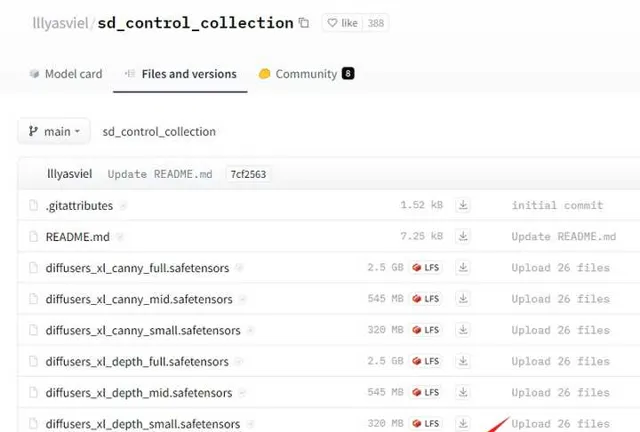

模型網站下載地址:https:// huggingface.co/lllyasvi el/sd_control_collection/tree/main網盤下載地址:https:// pan.quark.cn/s/df5c2e82 644c

模型網站進來以後選擇我們需要的模型「ioclab_sd15_recolor.safetensors」,點選下載按鈕進行下載。

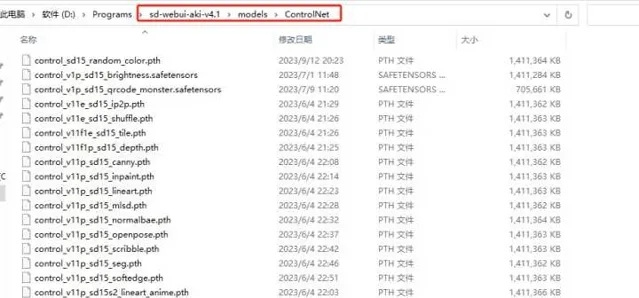

模型下載完成以後,把模型放到 SD 的指定目錄資料夾下:

\sd-webui-aki-v4.1\models\ControlNet

然後我們上傳一張需要上色的黑白老照片,點選啟用和完美像素模式,點選控制類別 Recolor,如果模型沒有載入進來,記得點下模型旁邊的重新整理按鈕。預處理器有兩種,小夥伴們都可以試試。

然後我們選擇一個真人大模型,如果只是上色,提示詞可以不用寫,直接點選生成就可以完成上色了,當然我們也可以在提示詞上指定我們想要修復的顏色。

以下就是黑白老照片修復的彩色照片了,分別使用了 Recolor 的兩種預處理器,小夥伴們可以看下效果。對於退色的老照片而言,又重換新生了有麽有?

還可以一鍵生成自己的專屬藝術照,用到了 EasyPhoto 外掛程式。

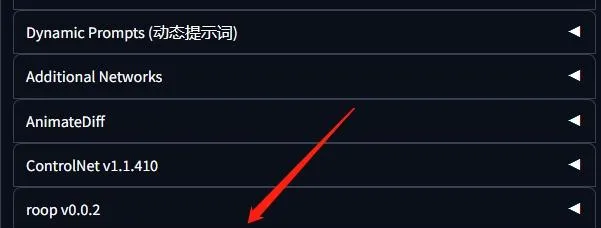

老樣子,先安裝外掛程式,外掛程式名「EasyPhoto」,需要在擴充套件中從網址安裝,輸入外掛程式的地址:https:// github.com/aigc-apps/sd -webui-EasyPhoto ,然後點選安裝重新開機 SD 。

安裝完成以後就可以在 SD 的界面上看到「EasyPhoto」的目錄了。

EasyPhoto 需要依賴 ControlNet 外掛程式,所以沒有安裝 ControlNet 的小夥伴記得安裝下 ControlNet 外掛程式,然後去 SD 的設定界面找到 ControlNet ,設定 ControlNet Unit 的最大數量要大於 3 。

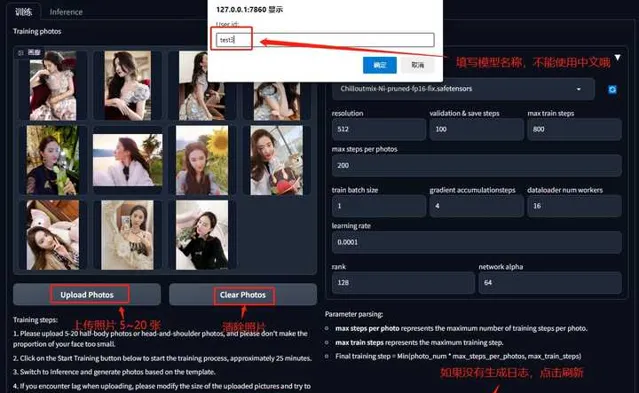

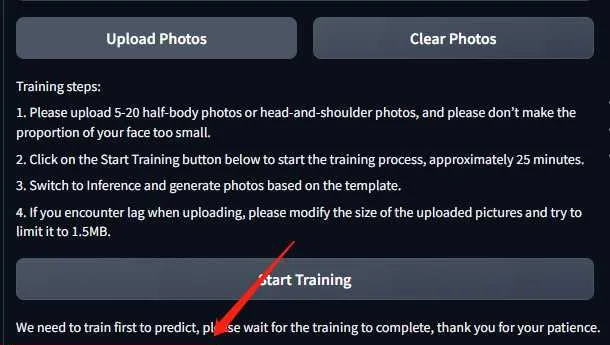

回到 EasyPhoto 的界面,選擇「訓練」,點選上傳照片, 這裏最好上傳 5 到 20 張照片,包括不同的角度和光照 , 最好是半身照 。如果不想生成戴眼鏡的照片,那就不要上傳戴眼鏡的照片或者比例低一些。

右邊的參數大家選預設就好了,如果需要調整,可以看下邊圖中的各個參數介紹。

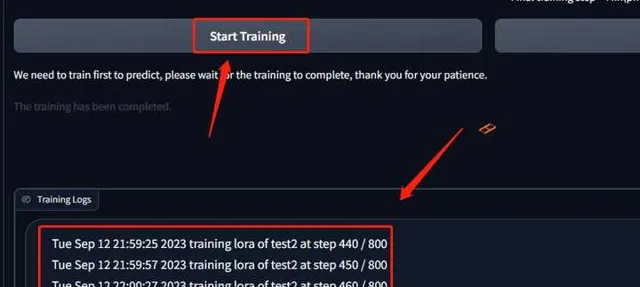

然後我們點選「Start Training」,並且填寫訓練模型名稱以後,就可以看到下邊的日誌,訓練已經開始了,第一次訓練的時候需要下載一些模型和依賴庫,會慢一點,小夥伴們要有耐心哦。接下來的每次訓練官方宣傳是 25 分鐘一次,聽雨試下來基本要半個小時的樣子。當然主要也看我們的電腦配置。

展示以下紅框中的資訊則代表訓練完成了。

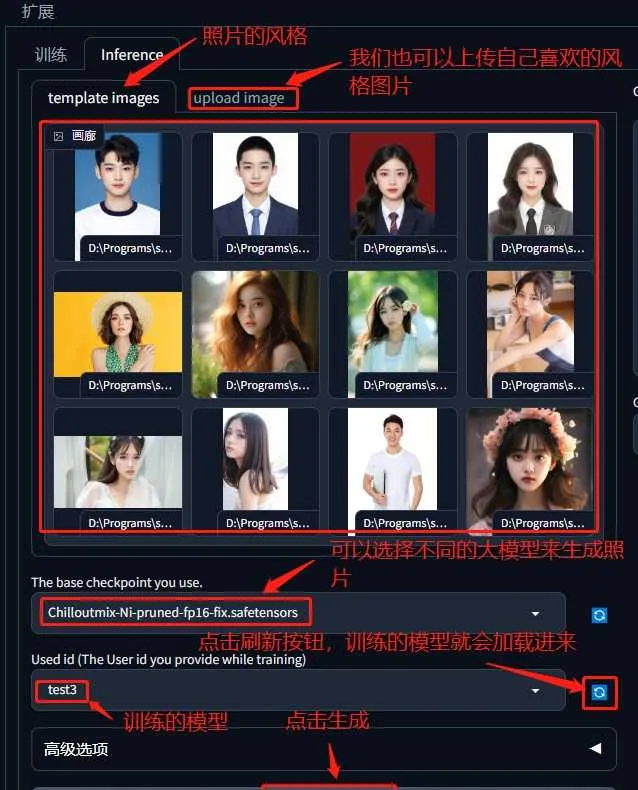

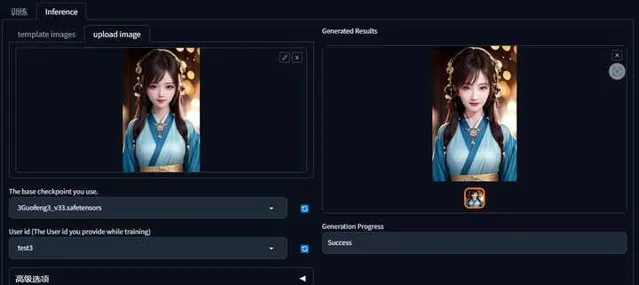

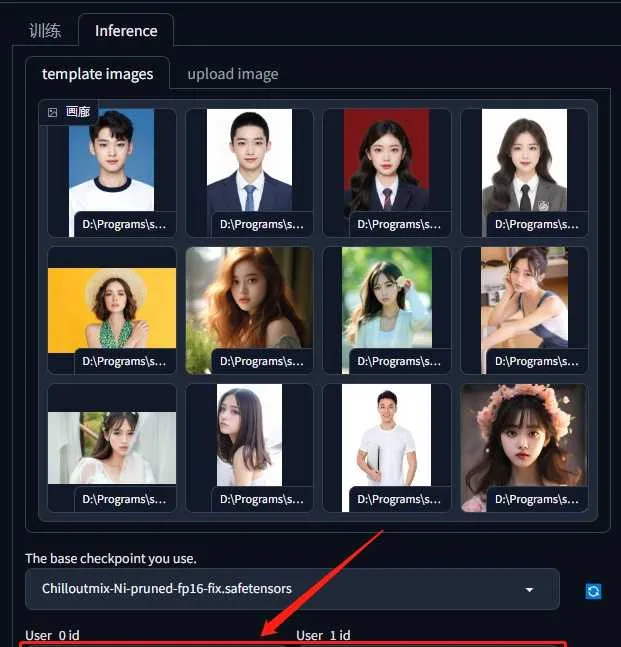

接下來我們就可以進入「Inference」中來生成我們想要的照片啦,可以在畫廊中選擇自己想要的風格,然後選擇大模型,再選擇我們訓練好的模型,高級選項參數預設,然後點選「Start Generation」開始生成。

模型盡量選偏真人的模型哦,我們隨便選一個風格生成看下效果,效果很可以哦。

我們上傳一張自己想要的風格圖片來生成一下看看效果,是不是也很 nice 。

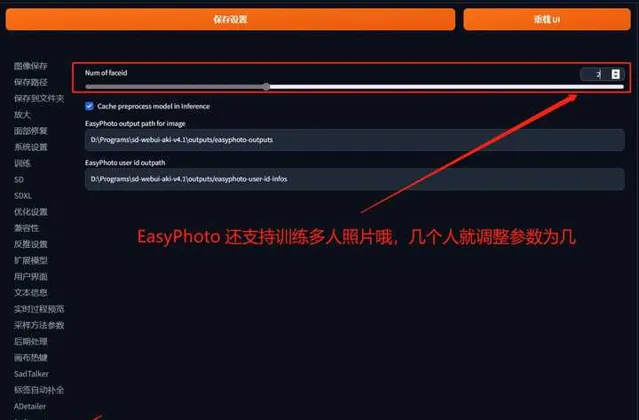

EasyPhoto 還支持生成多人樣版哦,在 SD 的設定中找到 EasyPhoto ,然後修改 「Num of Faceid」,你想要生成幾個人的照片就設定成幾,比如我們需要生成 2 個人的樣版照片,那就設定成 2 。

多人樣版和單人樣版的訓練是一樣的,需要單獨給每個人訓練模型,然後在「upload image」中上傳我們的多人照片樣版,EasyPhoto 本身是沒有提供多人照片樣版,所以需要我們自己上傳。

可以看到「Inference」中的訓練模型可以選擇兩個訓練模型了,如果「Num of Faceid」設定為 3,那這裏就可以選擇三個模型。

接下來的操作就和單人一樣了,選擇對應的訓練模型,點選生成就可以了。當然我們也可以只選「User_0_id」,「User_1_id」不選預設為 none ,這樣就生成只會替換你多人樣版中的左邊的人物的臉。

還可以用於模特換裝,用到了外掛程式 segment-anything。

首先安裝外掛程式「segment-anything」,在 SD 擴充套件中搜尋「segment-anything」,點選安裝,重新開機 SD 。

在 SD 的界面中出現這個選項就說明安裝成功了。

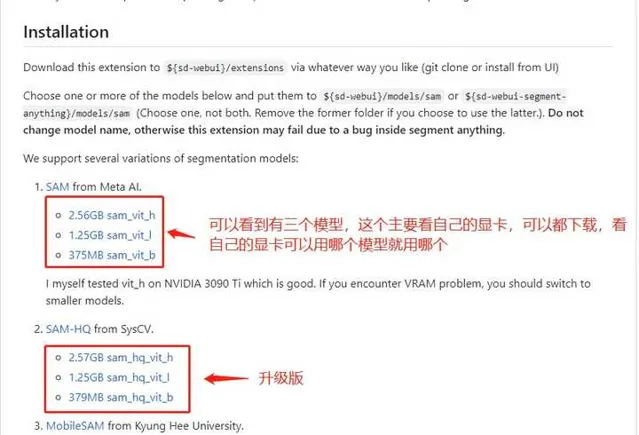

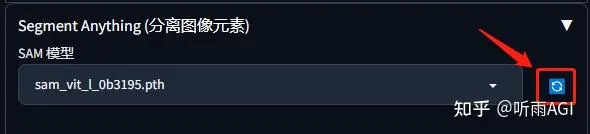

該外掛程式還需要安裝模型,可以去官網「https:// github.com/continue-rev olution/sd-webui-segment-anything 」的「Installation」部份下載模型。三個模型主要看顯卡的視訊記憶體大小,聽雨是 12G 的視訊記憶體,所以可以用最高檔,也就是「_h」結尾的模型。

模型也已經給小夥伴們整理在網盤裏了:

網盤連結:https:// pan.quark.cn/s/d8ee333d c224

模型下載完以後放到以下資料夾目錄下:

\sd-webui-aki-v4.1\extensions\sd-webui-segment-anything\models\sam

然後進入 segment-anything 的外掛程式界面,點選模型重新整理按鈕,載入模型。

選擇好模型以後,我們上傳一張圖片,比如我們想要提取人物眼睛的部份,我們只需要滑鼠左鍵點選眼睛,可以看到滑鼠左鍵點選以後,會在點選區域形成一個黑點。

然後我們點選預覽分解結果可以看到辨識的已經很精確了,但是還是可以看到鼻子上還有點瑕疵。

基於以上的瑕疵,我們就在鼻子上的有瑕疵的位置用滑鼠右鍵點選,會生成紅色的小點,這個紅色小點就代表不想提示的部份。

我們再試一下可以看到很完美了。可以準確提取眼睛的蒙版圖。

有時候使用這種標記也很難提取出我們想要的元素怎麽辦,蒙版裏總是會有一些東西亂入。

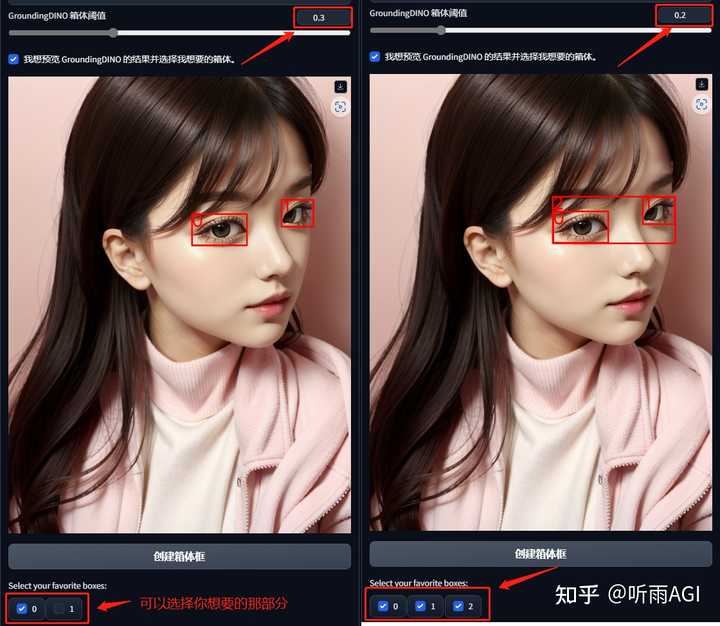

我們可以嘗試啟用「GroundingDINO」,這個功能是實作語意分割,就是我們只要輸入提示詞,比如我們想要提取眼睛的蒙版,我們只需要輸入提示詞「eyes」就可以了。

我們可以看到還有一個參數叫做箱體閾值,這個值主要是相同的提示詞可以提取出的元素的數量,值越小可以提取出的元素塊越多,值越大可以提取出的元素塊越少。

我們可以看到截圖底部存在箱體的編號,我們可以全部勾選,也可以只勾選我們想要的箱體。

比如我們只需要提取左邊的眼睛,那我們只需要勾選 0 就可以了,然後我們點選預覽分離結果,可以看到只提取了左邊的眼睛。

小夥伴們可能要問了,說好的商業換裝呢,在哪呢?

別急呀,這不就來了麽!

接下來我們來具體操作下蒙版的使用場景,比如商業換裝場景,但是不限於商業換裝一種場景哈。

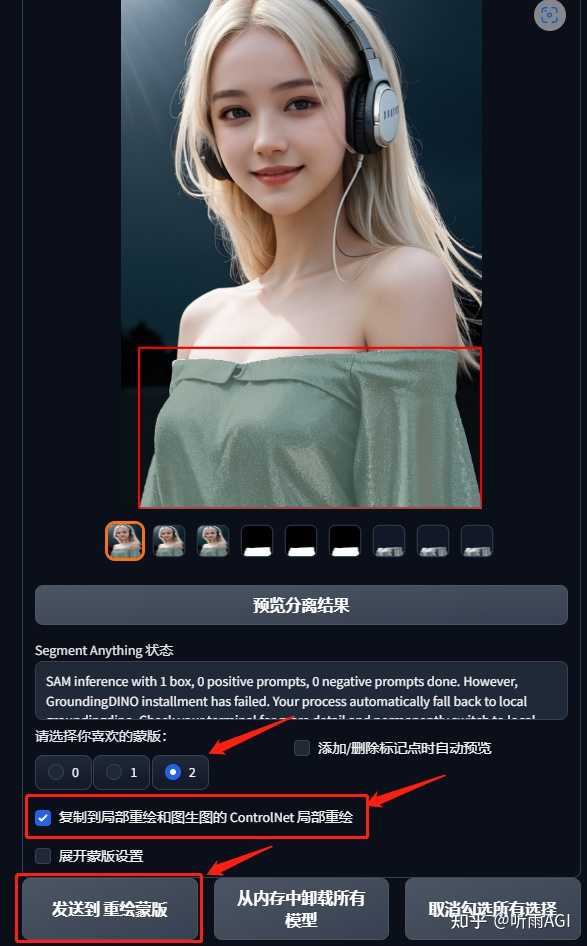

我們把下邊的小姐姐想象成一個假人模型哈,我們要把假人模特上的衣服換到一個真人上,這裏我們點選生成蒙版以後,選擇對應的3個蒙版中我們自己比較中意的一個模版,勾選復制到局部重繪和圖生圖的 ControNet 局部重繪,然後點選發送到重繪模版。

我們往上翻可以看到已經自動進入了上傳重繪蒙版選框中,這裏邊是看不到圖片的,實際是已經存在了,接下來我們把蒙版模式改為重繪非蒙版內容,重繪區域選擇僅蒙版區域。

然後修改我們的提示詞或者模型,點選生成。可以看到,衣服完美的替換到了另一個小姐姐的身上。

有做服裝電商的小夥伴,是不是只需要用假人模型拍個衣服的照片,用這種方式就有無數的真人模特了有麽有。還不快用起來!

如果用以上這種方式報錯了,那我們就手動把圖片和蒙版上傳到上傳重繪蒙版對應的位置就可以了

以上就是這個外掛程式在服裝電商領域的套用,其他的套用場景,由於篇幅有限,我們找個時間再講哈!

還可以用來嘗試不同的裝修風格,使用了 ControlNet 的 IP-Adapter 控制類別。

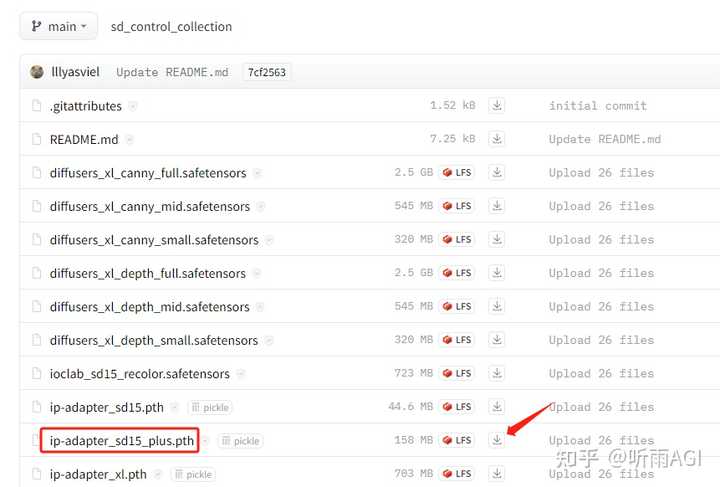

首先需要把 ControlNet 更新到最新版本。然後需要下載 IP-Adapter 的模型,可以去 huggingface下載,聽雨也給小夥伴放網盤裏了,小夥伴們也可以直接從網盤下載。

模型網站下載地址:https:// huggingface.co/lllyasvi el/sd_control_collection/tree/main網盤下載地址:https:// pan.quark.cn/s/df5c2e82 644c

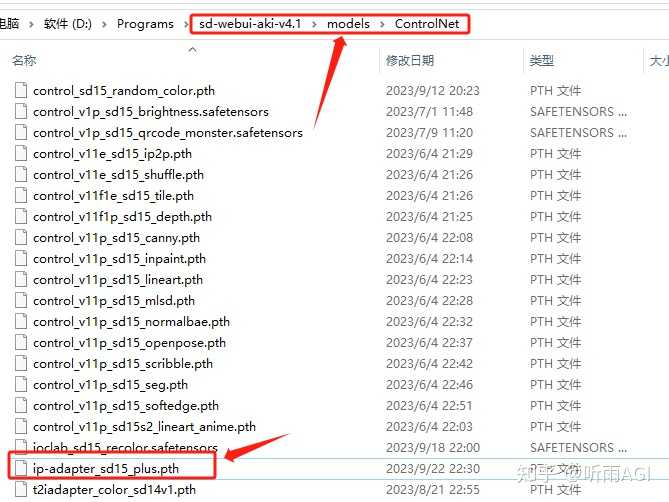

下載好的模型放入以下目錄:

\sd-webui-aki-v4.1\models\ControlNet

更新成功以後,就可以看到 IP-Adapter 了,我們選擇 sd15 的預處理,點選爆炸按鈕會自動下載預處理器。

如果下載報錯的話,網盤中聽雨已經給小夥伴們下好了。

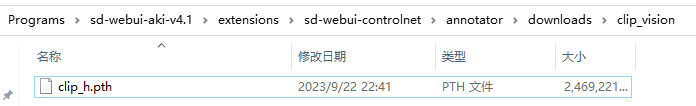

復制到以下目錄就可以了。

\sd-webui-aki-v4.1\extensions\sd-webui-controlnet\annotator\downloads\clip_vision

接下來我們就開始正式的來看下 IP-Adapter 怎麽使用。

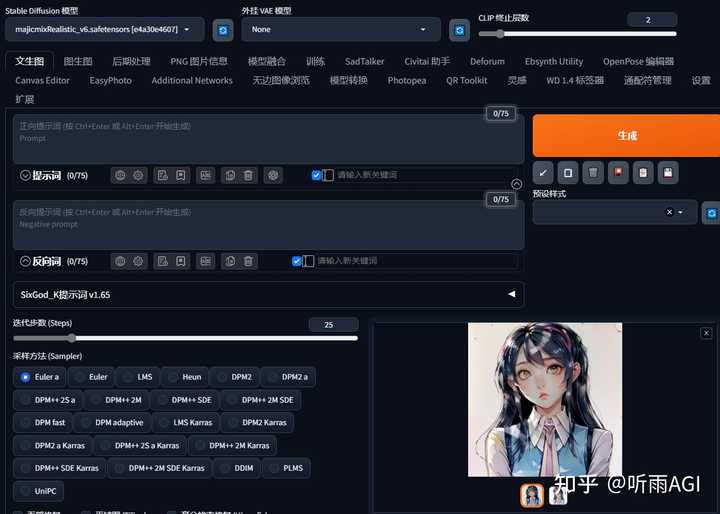

選中 IP-Adapter 控制器,一般預處理器和模型會預設載入,沒載入的話,點一下模型旁邊的重新整理按鈕,再沒有的話,就需要看下模型是否放入指定目錄下了。

點選啟用、完美像素模式、允許預覽,上傳我們希望復制風格的圖片,點選爆炸按鈕。

選擇一個我們想要的大模型,聽雨這裏主要是演示,就不寫提示了,我們直接點選生成,可以看到生成的影像和我們的原圖基本是一致的。

這是 IP-Adapter 最基本的用法,它還可以配合其他的控制類別組合使用,比如和 Canny 配合使用。IP-Adapter 保留風格,Canny 保留姿勢。組合生成自己想要的圖片。

再添加一個 ControlNet ,控制器選擇 Canny,上傳我們想要的人物姿勢圖,控制權重小於 1,聽雨這裏設定的是 0.8,然後我們點選生成。

可以看到風格和人物姿勢融合到了一張圖裏了。

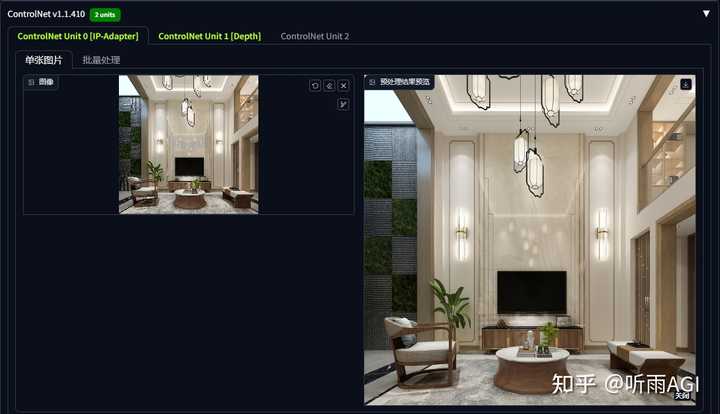

IP-Adapter 還可以和 Depth 組合使用。用來嘗試不同的裝修風格。

IP-Adapter 中上傳我們想要的風格圖片。

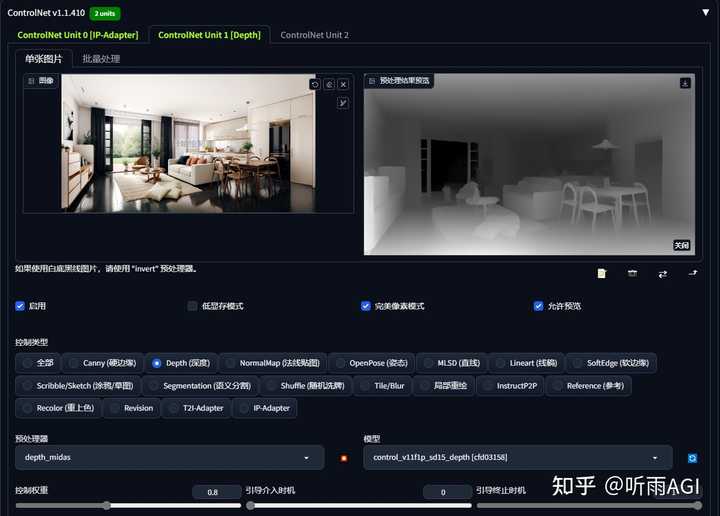

Depth 中上傳我們房間的布局圖片,預處理器和模型使用 Depth 預設的就行,然後記得點爆炸按鈕,控制權重設定小於 1。

最後點選生成。圖一的風格完美的融入了圖二的裝修布局上有麽有。想換什麽風格換什麽風格。總能找到一款我們喜歡的。

還可以用 ADetailer 來生成表情包。

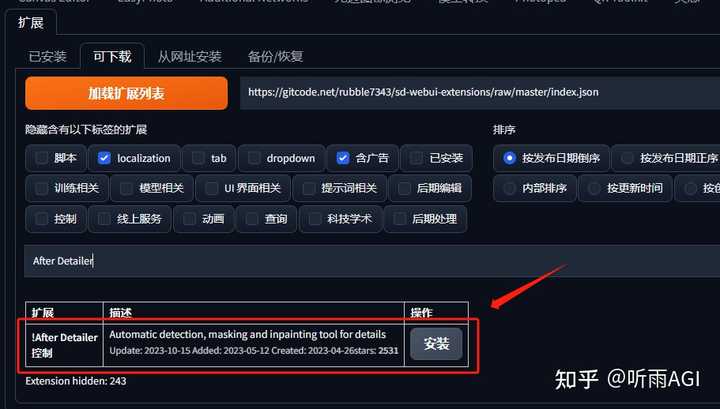

SD 的外掛程式擴充套件中搜尋「After Detailer」,點選安裝,重新開機 SD 。

SD 界面上有以下這個選項就算是安裝成功了。

外掛程式的基礎使用方法也很簡單,點選啟用,選擇對應的模型就可以了。

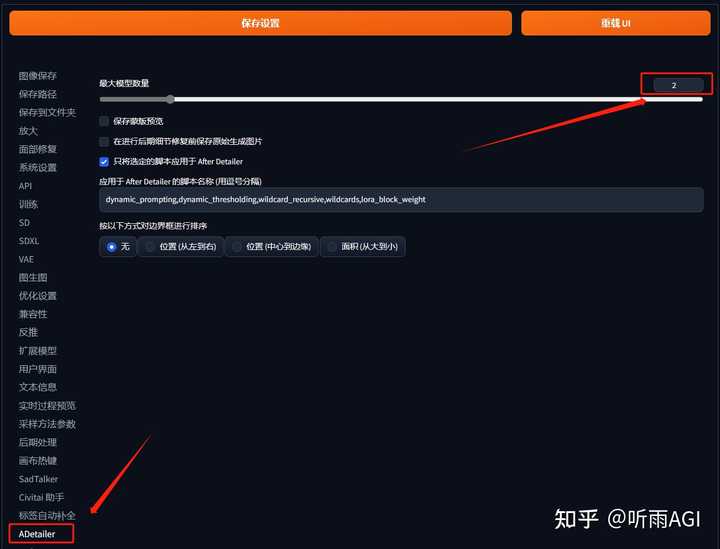

我們可以看到外掛程式有「單元1」「單元2」,如果不夠,我們還可以去設定裏找到「ADetailer」選項中修改單元數量。各個單元之間可以組合使用哦,比如單元1修臉,單元2修手,以此類推。

我們先來簡單介紹下 ADetailer 的模型,如果小夥伴們安裝外掛程式以後沒有模型,可以去huggingface下載,或者在網盤下載:

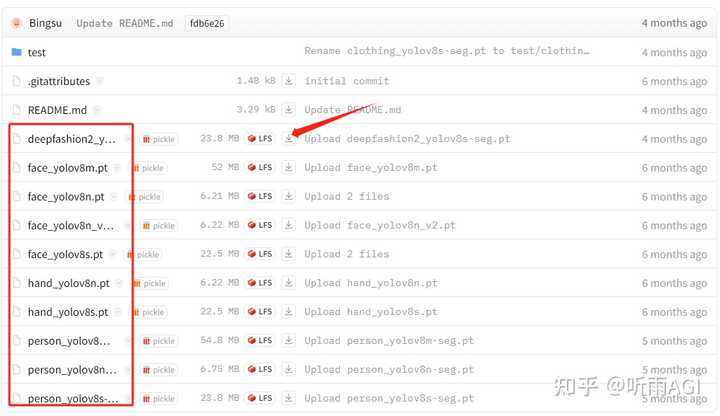

模型連結:https:// huggingface.co/Bingsu/a detailer/tree/main網盤連結:https:// pan.quark.cn/s/0167c820 9384

然後把模型下載復制到以下路徑下

\sd-webui-aki-v4.1\models\adetailer

加上外掛程式內建的模型,有以下這麽多模型,我們咋用嘞。可以看到幾個重復的單詞「yolov:二次元」「mediapipe:真人」「face:臉」「hand:手」「person:全身」。以上幾個單詞搞懂了,以下的模型我們基本就都知道咋用了。

接下來我們隨機生成一張圖片。可以看到臉崩了,然後我們再啟用 ADetailer 外掛程式,選擇真人臉部修復「mediapipe_face_full」,可以看到不僅修復了,臉部還給你加了細節有麽有,是不是比面部修復好使多了。

再看下這個外掛程式的界面,我們可以看到 ADetailer 外掛程式是可以填寫提示詞的,這裏你可以填寫一些增加面部細節的提示詞,有奇效哦!

然後今天不是還有一個生成表情包的功能沒講嘛,沒錯,這裏就可以用來輸入你的表情提示詞。在不改變人物的情況下,修改人物的表情。

聽雨這裏修改了三種表情,分別在原圖的基礎上生成了 3 張新的圖片,可以看到人物除了表情,其他基本沒有變化。是不是可以生成一個系列的表情包了!這裏需要註意下哦,要先固定隨機種子哦!

AI 繪畫的套用場景還有很多,以後慢慢補充。