感谢邀请,这是知乎里关于人工智能少有的一个颇有营养的问题贴,我站在通用人工智能的角度来说说吧。但上述问题并不容易回答,因为里面涉及到太多内容,所以我预感到我的回答会很长,现在很难预估到究竟哪些读者才能硬着头皮坚持看完,看完后还能看懂,看懂后还能一起进行有价值的更加深入的讨论。管他呢,先写出来回答再说,有没有同道就是后话了。

---- 内容概要 (感谢 @赤道无风带 让我做个提纲)---

1、有 一小群 分子一直没有放弃AGI这个AI原初的理想,成立了 AGI协会 并取得了一定进展;

2、本文基于 NARS 这一王培教授(美国天普大学)的AGI理论;

3、能够 思考 、有 情感 和 自我意识 的AGI系统已有软件工程的 实现 ;

4、但这样的系统 类似于人类婴儿 ,不会说话也不会分辨东西,只有后天的 教育 才能让其不断的成长。因此,真正有智能的AGI,跟人类一样,遵从基本一致的成长过程和大致相仿的学习经历(可参考发展心理学和儿童心理学)。所以, SAI应用做算法,而AGI应用要做教育 (现在人们对教育和学习的理解太过狭隘);

5、 绝不存在 某种超级 算法 ,也绝不存在某种 大数据 ,也绝不存在某种超级 计算力 ,能够从其中 产生智能 。而且,智能的适应能力是整体耦合的,不是集成的,正所谓牵一发而动全身。因此,SAI那种 分而治之再总体集成的想法,根本做不出智能 。AI发展史中有很多这样失败的计划或项目。

6、我们发现: 一、「奇点」是伪命题;二、「记忆移植」和「数字永生」也是伪命题;三、甚至连「常识」也是伪命题 ;

7、当前,谈论AGI的人有很多,但大多仅仅是泛泛而谈,现在需要的是理论。 离开坚实的理论,我们走不远的 ;

8、套用我喜爱的电影【山村老尸】中的一句话「我们一直被尸油搞错了方向」,在此换成「 我们一直被大脑搞错了方向 」。探寻智能的本质,可以有很多途径,而 通过解析大脑来研究智能无疑是最艰难的几条路径之一 。因为大脑是智能的生命载体,同一个器官承载了两种不同的能力,你说脑内的灰质和白质,还有一堆形态各样的精神组织,那些功能是关于生命能力的,那些功能是关于智能的?难以有效区分,弯路多多,如果觉得这条路是必然之选,那请您了解一下精神病学再回来看这个问题吧!莫不如研究AGI,还更纯粹些,也更直接。所以, 绝不是只有先研究明白了大脑,才能搞透AGI,真实的情况其实恰恰相反,借助AGI我们可以反过来推动脑科学、神经科学及精神病学的研究 。

9、AGI不是一个学科的问题,是 多学科深度交叉的问题 ,是有关人的学问中最本质的问题,跟心理学、逻辑学、精神病学、教育学关系更密切,但也与计算机科学、脑科学、哲学、社会学、人类学等学科有关。不过,仅从某一个学科出发,比如高大上的某种先进的算法或者某个哲学中的新名词,其效果大多只是隔靴搔痒而已;

10、我做的是AGI的科学研究,既lonely又苦逼,识货的人也少得可怜,跨的领域太多课题也申请不上,不过没事,我倒是信心满满,我这科研不为名不为利、不求SCI或SSCI,JUST FOR FUN而已,大家等我们的好消息吧;

11、如果有路过好奇者,可以看看这里,是我们AGI组织三年的 官方活动内容 ,做AGI我们是认真的:

16-17年:https:// home.x-in-y.com/course/ view.php?id=35

17-18年:https:// home.x-in-y.com/course/ view.php?id=34

18-19年:https:// home.x-in-y.com/course/ view.php?id=52

12、 对于培养后代最大的启示就是 :人的肉体并不是特别重要的,最重要的是自己的精神世界,我们叫做个体的经验系统。这个系统先天知识为0,遗传给我们的技能在出生后起作用,这很快就被学到的社会性经验替代了,而遗传基因中的反射性设定,但并不是知识。个体经验系统是活的,是成长的,也是需要培育的,可以转置成树状结构,从树的叶节点开始将直接感知经验进行抽象,树的根节点只有一个,就是「抽象自我」,这是人格、自尊等的上位结构。距离抽象自我越近,越抽象,层次越高,影响越大。由于抽象自我是从小开始建构的,所以我们儿时的经验积累对于抽象自我的建构起着决定性的作用,或者可以说抽象自我就是儿时经验的最高层次的直接抽象。难道大家不奇怪吗,我们长大成人后,小时候的很多经历都在无形中影响着自己,而不管你读过多少书、上过多少学、结过多少次婚、赚了多少钱。而其中,与抽象自我直接关联的最上方的结构与儿时生活环境直接相关,所以我一直强调:如果你没结婚就算了,万一你结婚生了孩子,在孩子上小学之前,千万千万不要想着挣钱就把孩子丢给老人,也不要只是让女方或男方当方面地带孩子。孩子们的成长只有一次,他们的童年也有且只有一次,对孩子抽象自我的塑造不可逆、对孩子教育的影响不可逆,哪怕生活很艰难很困苦,只要有父母的陪伴、只要这个穷家是幸福的,孩子的内心就是健康的。钱,可以回头再挣;但,孩子内在经验结构的缺陷却是永无补救的。比如,留守儿童,小时候还不太容易看出来,但婚后和工作后,跟健全家庭的孩子们的差别就会越来越明显。这个问题现在很严重。

13、鉴于目前私信、评论本回答的对智能、对智能系统目标生成和维持、任务执行等多种更为具体的问题,在此附加王培教授智能论的 科普文集(AGI入门) 链接地址如下:

【 当你谈论人工智能时,到底在谈论什么? 】(介绍AI的几大学派,我们是最后一个原则派)

【 人工智能:何为「智」? 】(对智能理解的差异,是AI和AGI的根本不同,此文说明了我们的智能观为什么是有限适应)

【 计算机能有创造性吗? 】(有人说,机器绝不会拥有创造力,那是人类才有的。其实,当然不是这样)

【 「意思」是什么意思? 】(能否具有理解能力,而非现在的所谓机器学习能力,是AGI的一个核心标志,也是语义落地这个历史性难问题的核心,我们的观点很明确:基于经验的语义学)

【 证实、证伪、证明、证据:何以为「证」? 】(我们脑中的知识,究竟是如何起作用的?这属于知识论范畴的回答)

【 人工智能迷途:计算机的高技能等于高智能吗? 】(算力牛X的机器,也许一点智能都没有)

【 人机大战赛前思考 | 计算机会有超人的智能吗? 】(AlphaGo的分析)

【 机器是如何被骗并骗人的? 】(不要过度迷信专用人工智能)

【 人工智能危险吗? 】(适应性系统的危险性和人类一样,有好的也有坏的,全看教育是怎么塑造它们的了)

【 图灵测试是人工智能的标准吗? 】(结论就是,图形测试根本不能构成AI的智能判别标准。时下,有些人专门测试AI系统的人类年龄,比如达到3岁小孩等,都是liars)

【 你这是什么逻辑? 】(用什么样的逻辑能够解决现在深度神经网络搞不定的事呢?)

【 深度神经网络会产生人这样的智能吗? 】(答:不能)

【 计算机将拥有『常识』?还有很多关要闯 】(你觉得常识不重要?好吧,你肯定不是做AI的)

【 机器翻译会迫使翻译们全失业吗? 】(基于统计的机器翻译不会的,但若是基于理解的呢,就......)

【 人工智能怎么为自己设定目标? 】(AGI系统如何给自己设定目标,从内在新生目标)

【 杞人忧天2.0:你真的了解「通用人工智能」的定义吗? 】(不存在「奇点」一说)

14、放两个Demo把,省的SAI的人认为我们每天只能空谈理论:

(1)跨越障碍。NARS系统本身并不含有任何跨越障碍的预设算法,一开始只是告诉系统可以做的基本动作,然后设定一个目标,接下来就是自学了。刚开始还比较笨,后来动作和预判就进步了:

https://www.zhihu.com/video/1040658897673170944

https://www.zhihu.com/video/1040658897673170944

(2)内部经验空间。也许这就是大脑里的工作的一个场景吧(开玩笑),都是实时工作的。

https://www.zhihu.com/video/1040647219413708800

https://www.zhihu.com/video/1040647219413708800

(3)这是1.6的版本学习打乒乓球的过程。

https://www.zhihu.com/video/1040659123393773568

https://www.zhihu.com/video/1040659123393773568

--------------------------------

如果大家想进一步了解AGI与教育的相关问题,请参阅以下论文:

[1]刘凯,隆舟,刘备备,王伟军,王培.何去何从?通用人工智能视域下未来的教师与教师的未来[J].武汉科技大学学报(社会科学版),2018,20(05):565-575.

[2]刘凯,胡祥恩,马玉慧,那迪,张昱华.中国教育领域人工智能研究论纲——基于通用人工智能视角[J].开放教育研究,2018,24(02):31-40+59.

[3]刘凯,胡祥恩,王培.机器也需教育?论通用人工智能与教育学的革新[J].开放教育研究,2018,24(01):10-15.

或到专栏:通用人工智能 下查看

-------------------正文部分-----------------------

一、相关概念的解释

近期,对于人工智能的观点,同时存在如下三种理解:第一种,认为人工智能包括计算智能、感知智能和认知智能三种;第二种,认为人工智能分为弱人工智能和强人工智能两种,而强人工智能也正是通用人工智能;第三种,认为人工智能分为专用人工智能和通用人工智能两种。也即:

AI = Computational Intelligence + Perceived Intelligence + Cognitive Intelligence

AI = Strong Intelligence + Weak Intelligence

AI = Special-purpose AI + Artificial General Intelligence

到底哪种更合理呢?

第一种分类常见于行业演讲和报告中,既缺乏理论依据,又具有误导性:逻辑上貌似完整无缺,又与「奇点」不谋而合。其中,计算智能(又称运算智能)指的是快速计算和记忆存储能力,感知智能指的是视觉、听觉、触觉等感知能力,认知智能则指抽象理解的能力。对于计算系统而言,计算智能对应于计算水平,感知智能对应于感知水平,而认知智能则对应于认知水平,三者由低至高逐级更加「智能」。现在计算智能和感知智能业已成熟,那么随着技术的发展,在给定这一框架的前提下,认知智能也应该可以实现,毕竟前两者已经做到了。然而,无关乎最后的认知智能是否最终必然实现,关键问题在于框架的前提就有问题。事实上,计算能力和感知能力只是实现智能的必要条件,而不是智能本身,所以将计算智能和感知智能也划入智能的分解只是一个玩弄逻辑概念的把戏而已,在不能够真正地解决任何实质性问题的同时却极大提升了「认知智能必定能够实现」的信念和预期。因此,如果不能详实检视这个前提,那么所得到的后续结论便经不起推敲。

第二种分类多见于哲学论述中,最早由赛尔提出(Searle J,1980)。他认为,弱人工智能的计算机其价值主要是为心智探索提供有效的工具,而强人工智能则意味着某种程序化系统的运行本身就处于心智状态中,能够真正理解事物并具有自己的认知状态(唐热风,1998)。对此,徐英瑾专门撰文写道:大众理解的「强—弱」之分在于智能的宽与窄之分,而塞尔心中「强—弱」之分却是真假之分。然而,这种区分并不是没有意义的,起码说明了「人工智能在各个领域内的量的积累,未必会导致真正意义上的智能的涌现」(徐英瑾,2018)。于是,在赛尔看来即使一个计算机系统的外在表现完全像人,那也只是个「弱人工智能」,而「强人工智能」必须真正拥有自我意识。这是很多通用人工智能研究者不认可的,因为在此分类下人工智能系统的「强弱」之别就没有任何外部标准来衡量了(王培,2016)。可以看出,「强人工智能」并不是智力能够全面接近乃至超越人类智能的机器智能,而「弱人工智能」也不是指对人类智能的某些方面的模仿。所以,从原始学科向其他学科的概念「转移」中,其内涵和外延已经发生了变化,正如「奇点」一样。

第三种分类则出自人工智能技术领域自身,即认为人工智能包括专用人工智能(Special-purpose AI,SAI)和通用人工智能(Artificial General Intelligence,AGI)两个不同的子领域。对于「智能」理解的根本差异,使人工智能分化成为专用和通用两个不同分支。专用人工智能采取先做后思的路径,即一开始并不深究智能也不对智能做清晰的定义,而是通过技术迭代渐进式地提升智能化的程度。通用人工智能认为智能的存在代表着可以被认知的理性原则,采取的是先思后做的路径(刘凯,胡祥恩等,2018)。与人工智能早期工作时所使用「AI」非常相似,「AGI」的表述在2005前后被核心研究群体认可和采用,希望将他们的目标与当前「AI」(即SAI)区分开来。随后,AGI学会的年会及其学报于2008年及2009年相继启动。由于AGI项目的做法往往与主流AI社区有重大差别,所以尽管近年来「AGI」一词大热,但相关研究成果却基本鲜为人知。

因此,上述 三种分类既有关联,又彼此不同,且三者不能简单等同 :「计算智能+感知智能」既不能简单等同于「弱人工智能」,也不能简单等同于「专用人工智能」。同样地,「认知智能」既不能简单等同于「强人工智能」,也不能简单等同于「通用人工智能」。事实上,也只有第三种分类适用于当前语境下的严谨讨论。

二、智能观

「什么是智能?」,对于智能本质的不同理解是当前人工智能领域诸多流派形成的根源。

(一)常见观点总结

我把王培老师的总结翻译过来列举如下:

基本观点:既然人类智能是人脑的产物,那么"尽可能按照原样复刻人脑结构"便是利用计算机实现智能的可行途径

理论基础:神经科学,生物学,等

典型代表:HTM,Vicarious

主要挑战:有太多生理细节既不可能也无在AI系统中复制的必要

基本观点:智能表现为人类的外在行为,所以只需让计算机表现得"与人一样"即可

理论基础:心理学,语言学,等

典型代表:Turing Test,cognitive model

主要挑战:有太多心理和社会因素既不可能也无在AI系统中复制的必要

基本观点:人们通常智能可以问题解决能力来测试智力,因此智能系统也要能够解决现在只有人类才能解决的那些问题。

理论基础:领域知识导向下的计算机应用

典型代表:AlphaGo,expert system

主要挑战:缺乏对智能问题的界定,专用解决方案的通用性和弹性不足

基本观点:智能是诸如感觉、推理、学习、行为、交流、问题解决等一系列认知功能的整合。因此,在计算机中分而治之地实现这些功能就能够实现智能。

理论基础:计算机科学

典型代表:主流AI教材,Soar

主要挑战:AI技术发展至今内部已经相当分散和僵化,难以有效整合。

基本观点:智能是一种理性或优化的形式。因此,智能系统应该总是能够按照某种通用原则而「正确做事」。

理论基础:逻辑学,数学,等

典型代表:AIXI,NARS

主要挑战:智能和认知中的影响因素太多,以至于难以被一种理论解释或生成。

自上而下,上述派别对人类智能的描述对应于越来越通用化的理论以及相应计算机中的系统实现。由于对智能的不同描述具有不同的粒度和范围,尽管各个派别的目标相关,但依旧差异明显、相互不兼容。实现其中某一目标的最优方式却往往对其他目标的实现帮助有限。[更为详细的讨论请见这里]

(二)我们的智能观

人工智能当前的混乱现状,根源于对智能本质理解的差异。我们认为,「智能」不是解决具体问题的能力,而是习得这些能力的元能力,即是否智能不在于能做到什么,而在于在何种条件下做到。进而提出, 「智能」本质上是一个系统在知识和资源相对不足情况下的适应能力 。这种「相对不足」表现在三个方面:1) 有限性 ,智能系统只能依赖于有限的信息加工资源,比如处理器数目和速度以及存储空间容量。对于智能机器人而言,有限性也包括能量储备和直接感知运动能力;2) 实时性 ,智能系统必须实时工作,新任务可能在任意时刻到来且均有时限要求,因此多个任务会竞相争夺系统资源;3) 开放性 ,智能系统必须对未来经验抱持完全开放的态度,新知识可能和已有知识相冲突, 新问题也亦可超出系统的知识范围,但均不应导致系统瘫痪。

首先,「知识和资源相对不足」需要进一步澄清。「资源不足」是说,尽管系统的信息加工能力(处理器数量、速度,存储器容量,等等)是有限的,它却必须实时工作,即新任务可以随时出现,且带有时间要求。因此时间不足(没时间想)、空间不足(没地方装)是常态。「知识不足」是说新任务常常超出已有知识的范围,而且所有已有知识都可能被新知识挑战。

这些不足是以往的理论模型(经典逻辑、概率论、图灵机)所未完全考虑的。尽管每个具体系统都仅有有限的能力、知识、资源,但这些模型都假定,它们已经足以完成系统所需应对的任务。以计算模型为例,系统只负责解决那些它已有算法,而且能满足其时空资源要求的问题。对一个超出系统知识和资源范围的问题,它基本上不能提供有价值的答复。如果你问了计算机这样一个问题而它答不上来,那是你的错,不是它的错。

这不是一个智能系统应该做的。我们经常遇到新问题,而且一般没有时间去考虑一个问题的所有相关因素,我们的智能恰恰是这种情形下才得以展现的,而不是体现在那些我们已经预知详细解法,且有足够的时间来依此行事的问题上。对后一种问题,我们会说其解决是「机械的」或「本能的」,是不需要「动脑子」的。

能够在「知识和资源相对不足」的条件下工作只是这个智能定义的一半,而另一半是关于如何在这种条件下体现「理性」。这里的关键概念是「适应」。具体说来包含两点:以过去的知识应对未来的情况;以有限的资源应对无限的需求。有适应能力的系统依据经验决定自己的行为,即使在遇到前所未见的问题时,也会比照已知的类似情况定下对策。当需要考虑的事情超出系统的思考能力时,适应性意味着集中精力于最重要的事情,而什么是「重要」的,也是根据过去经验确定的。

既然系统对未来经验抱开放态度,那就是承认了未来经验和过去经验可能不同,因此也就无法保证自己行为的绝对正确性。在这里,「适应」是一种「尽力而为」的努力,其合理性是不以结果的成败而论的。因为目前的应对都会成为未来的经验,即使失败的尝试也会对未来的决策做出贡献。在一个相对稳定但仍充满变化的环境中,「尽人事,听天命」比「以不变应万变」和「既然天意难测,何妨任意为之」更体现适应性,因此更合乎理性。这种理性是相对于系统的以往经验和当前资源供应的,因此可以解释系统的错误。「智能」绝不是「全知全能」,但就算错,也要错得情有可原。

当我们考察一个系统的智能时,其着眼点一般不是看它能解决什么问题,而是看其能力是事先确定并无法改变的,还是在经验中逐渐形成并保持一定的可塑性的。这也正是传统的计算机系统和人脑的主要差别。即使是现有的各种机器学习算法,也仍然是基于各种知识资源相对充足的假设,并且其学习结果往往收敛于一个确定的输入—输出映射。按照这些传统观点,每个问题都有一个「正确的」解,和系统的经验与处境无关。但根据上述「相对理性」,什么样的解是「正确的」常常(尽管并非永远)是和系统的经验与处境有关的。

如此一来,本文所描述的这个智能定义和其它智能定义的关系也就清楚了。按照这个标准,一个智能系统不必在内部结构或外部行为上和人脑「形似」,但必须在理性原则上与其「神似」。一个计算机系统是否有智能,不在于某一个时刻它能解决什么实际问题,而在于它提供的解是否依赖于系统的历史和处境。

三、我们的学习观与「奇点」论

我们的学习观是一种「大」学习观,指的是同时涵盖了机器学习和人类学习两种貌似不同学习行为的一般意义上的学习的基本看法。

「奇点」(Singularity),也被称为「技术奇点」,是从数学和物理学科中泊来的一个概念。 尽管常见于影视文学作品而为公众所熟知,但它却并不是一个真正意义上的计算机科学或技术术语 。历史上,1982年美国人工智能协会年会上Vinge首次提出「技术奇点」,并于1993年再次论述了这个观点(Vinge V,1993),并认为技术奇点有可能在未来50年左右就会出现。2005年,在【The Singularity is Near: When Humans Transcend Biology(奇点临近)】一书的推动下,「奇点」的翻版──「库茨维尔定理(Kurzweil's Law of Accelerated Return)」被广泛宣传。该定理指出,人类出现以来所有技术发展之初都是缓步前行的,但随后以指数的形式快速增长,并最终以指数的指数形式增长。因此,「超级智能」(Super Intelligence)必将出现并威胁人类自身(Kurzweil,2004)。

针对人工智能,「人工智能将走向奇点」(「奇点」论)基于如下前提:

- 系统的智能水平可以表征为一个数值;

- 经由学习或迭代改进,人工智能主体能够不断提升自己的智能水平;

- 当人工智能超越人类智能水平之时,它的整个未来将被视作一个单点,因为那以后的发展已经超出了人们的理解力。

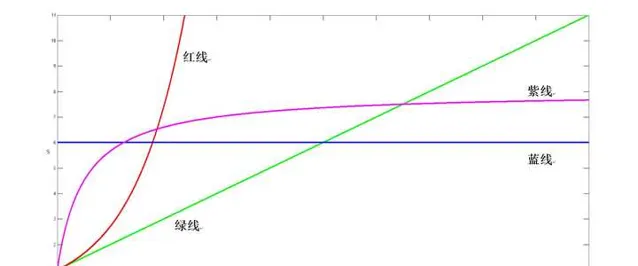

第一句话看似有理,毕竟一个「智能」或「智慧」的系统应该可以解决许多问题,而人们也总是利用各式测验和检测来评估效果,比如人类自己便使用「智商」(IQ)来衡量智力水平。然而,智商的准确性和科学性一直存在相当大的争议(斯蒂芬▪默多克,2016)。即便存在,它也无法体现智能的变化因素。通常情况下,提及智能一般与「后天习得的解决问题能力」相关,而非「先天预置的问题解决能力」。于是, 在某一给定时刻T,系统的智能应该用该时刻能力的增速来衡量,即可用S(t)表示「问题解决的能力」,而用其导数S' (t)表示「学习的能力」 。

如图1所示,依据系统所能解决问题的数量S与时间T的关系大致可区分出四类不同系统(Wang P et al.,2018):①蓝线对应于一个完全没有学习能力的系统。系统技能全部由先天给定,即S' (t) = 0。所有传统的计算系统都属于此类,其中一些被视为「AI」;②紫线对应于一个学习能力有限的系统,绝大多数的机器学习算法都属于该类。尽管S' (t) > 0,但最终将收敛到0;③绿线对应于一个学习能力基本固定的系统,许多AGI项目都属于这种类型。此时,S' (t)是一个正常数;④红线对应于一个学习能力本身无限增长的系统,其S(t)和S' (t)均呈指数递增。虽然我们认为这样的系统并不可能真实存在,但为了讨论方便而将其作为一种可能概念列出。

取决于诸函数中所包含的常量和测量的时刻,在某时刻这四种类型中的任意一种都可能成为当时问题解决能力的最强者。但它们的学习能力却各不相同,由弱至强可排序为:蓝线族 < 紫线族 < 绿线族 < 红线族。所以, 「能够解决多少问题」与「能够学到多少东西」其实并不一般相关 。

尽管学习往往与问题解决被置于同一层面,但「学习是智能核心」的见解却早已有之。我们也认为,各类问题的具体解决能力处于对象层次,而学习能力则是处于元层次。对「绿线族」或「红线族」而言,S(t)虽能够提升至任意层次,甚至「比人类聪明」,但受传感器、动作器及经验所限,并不意味着每个问题都能比人解决得更好。在这一问题上,「绿线族」和「红线族」之间存在根本差别:由于「绿线族」内部的元层次知识由其设计者指定,所以即使S(t)值远高于人类水平,但人们仍然能够理解它的运行原理及基本工作过程。而相反,若真的存在某个「红线族」,它将在某个节点之后让人连它是如何工作都变得无法理解。

虽然「奇点」的支持者经常用「指数增长」现象进行佐证,但指数增长根本不会在某个自我改进的孤立系统中持续进行下去,而通常体现在种群之中。纵然「智能」只是一个程度的问题,但没有证据表明「智能水平」在「人类水平」之上依旧可以无限提升。对应于「低于人类水平的智能」,「超级智能」作为一种逻辑类推,却包含对象层次及元层次的双重提高之意。S(t)值显然可以通过知识、技能或计算资源任意一点或多点的增长而提高,但「超级智能」和S(t)值并不相同。在元层次上,「超过人类」的智能将是一种彻底不同的「上帝」思维机制,不论在何种情况下都能找到全局最优解。当然,尽管不否认这种可能性,但至今并没有其确实存在的任何确凿的支撑证据。 因此,基于我们的智能观和学习观,「奇点」是永远无法实现的。

四、我们的教育观

表面上看,人工智能似乎和教育学相距甚远,实则不然。不论专用人工智能还是通用人工智能都与教育学关系密切。尽管相关研究极为匮乏,但机器学习和机器教育两个不同问题的分化却逐渐明晰。

机器学习(Machine Learning,ML)是当代专用人工智能的技术核心,聚焦于从数据中发现规律的算法,将学习问题定义为训练经验对任务执行时性能改善的度量(Jordan M I,Mitchell T M,2015)。机器学习最初仅是计算机科学的一个子领域,但随着统计学习带动下人工智能的兴盛,机器学习已经成为具有严谨体系和理论基础的学科。机器学习除了以回归、决策树、SVM、贝叶斯等算法为主的经典符号主义外,还有以深度学习和强化学习为核心算法的连结主义和行为主义两个分支(冯锐,张君瑞,2010)。尽管机器学习应用甚广,深度学习和强化学习更是成效斐然,但此类「学习」却过于狭窄:本质乃是空间搜索及函数泛化,实则将学习过程等同于计算过程,仅仅是预设算法基础上输入输出的重新投射而已,并无多少智能可言(Fabio Ciucci,2017)。

比机器学习更进一步的是,通用人工智能面向机器教育(Machine Education,ME)问题。以NARS系统为例,相同的教学内容(待输入知识集),一次性「填鸭」灌输与分批渐次录入相比,其学习效果完全不同,后者更胜一筹;分批渐次录入与录入过程中适时向NARS发问相比又有很大差异,后者效果最为理想。对于不同的教学内容,知识组织方式对学习效果影响甚大,学习材料由浅至深则比由深至浅的效果好,知识的模块化输入又比分散输入的效果好。由此可见,通用人工智能系统的学习理论,不仅涉及教学的内容,也同样涉及到教学的方式和方法。因此,其已然冲破「机器学习」算法的藩篱,而跨入更为广袤的「机器教育」层次之中。

上述「教」的问题,同时存在于专用人工智能及通用人工智能领域之中。不过,教育不仅仅只是「教」。真正的教育,既要「教」又要「育」。对专用人工智能而言,其算法具有专用性,特定问题的解决有赖于特定算法及相应参数。一旦训练完毕,输入输出之间的对应关系便确定下来,计算时并不会发生改变。 专用人工智能的特点是「算法即教法」 ,因此有「教」而无「育」。然而, 通用人工智能却「教」与「育」都需兼顾 。通用人工智能之所以冠以「通用」二字,就是因为其不预设解决具体问题的任何算法。从最初一无所知的机器婴儿到具备外部世界的基本常识,从简单的人机对话到掌握一定的实用技能,从被动接受外部信息到按自身兴趣「量体而寻」,每个成型的通用人工智能系统皆是培育出来的,整个过程和人类培养自身后代一样,只是速度和效率有异而已。不过,正所谓「近朱者赤近墨者黑」, 通用人工智能系统的教育经历对其道德判断和最终行为具有决定性影响 。在其成长之路上,「好人」能够培育出「好的」系统,「坏人」能培育出「坏的」系统。由此可见,「教」和「育」二者皆不可偏废。

更深入地,一方面,通用人工智能类似人脑,可以有效利用小数据,且结果总是可分析、可解释和有意义的,这是经验导向的技术回归;另一方面,通用人工智能本身的教育问题,令人文关怀得以保持和传承,其强调教育过程中教育者和学习者双向交互和建构的重要性,彰显了人文精神的回归。通用人工智能的教育问题包含「教学」与「育化」两方面,前者指通用人工智能系统的机器教育该如何实行,即「教材」和「教法」;后者是如何培养及规范「机器学生」的品行而与人为善,即教学过程中的「德育」。

对于「教材」和「教法」,机器教育可以参照人类的教育过程。以NARS为例,在最初的系统测试和运行中,我们一开始沿用机器学习「灌数据」套路,经无数次失败和调优后惊奇地发现,所有提升NARS学习效果的做法其实同样适用于人类。这意味着一定存在比当下内涵更大也更为一般和普适的教育范畴,这为教育研究工作者开启了一扇通向新知的大门。直至今日,在NARS系统习得「新知」、获取「信念」、通过操作掌握「技能」之时,「由浅入深」及「适时适度」的人类教学原则仍被恪守。然而,必须说明的是,与人类相仿,「知道」并不意味着「懂得」。 通用人工智能系统不仅可以为自己设定目标,而且其背后所依据的信念也可以发生变化。简单地输入并赋予高信度的「爱护人类」「维护地球和平」等知识尽管简单易行,但这种缺乏理解的知晓也只是教条而已,实效欠佳 。德行不是说教而是通过经验的积累和塑造的,「育」乃是一个人类和通用人工智能系统共同存在的操作性难题。