感謝邀請,這是知乎裏關於人工智慧少有的一個頗有營養的問題貼,我站在通用人工智慧的角度來說說吧。但上述問題並不容易回答,因為裏面涉及到太多內容,所以我預感到我的回答會很長,現在很難預估到究竟哪些讀者才能硬著頭皮堅持看完,看完後還能看懂,看懂後還能一起進行有價值的更加深入的討論。管他呢,先寫出來回答再說,有沒有同道就是後話了。

---- 內容概要 (感謝 @赤道無風帶 讓我做個提綱)---

1、有 一小群 分子一直沒有放棄AGI這個AI原初的理想,成立了 AGI協會 並取得了一定進展;

2、本文基於 NARS 這一王培教授(美國天普大學)的AGI理論;

3、能夠 思考 、有 情感 和 自我意識 的AGI系統已有軟體工程的 實作 ;

4、但這樣的系統 類似於人類嬰兒 ,不會說話也不會分辨東西,只有後天的 教育 才能讓其不斷的成長。因此,真正有智慧的AGI,跟人類一樣,遵從基本一致的成長過程和大致相仿的學習經歷(可參考發展心理學和兒童心理學)。所以, SAI套用做演算法,而AGI套用要做教育 (現在人們對教育和學習的理解太過狹隘);

5、 絕不存在 某種超級 演算法 ,也絕不存在某種 大數據 ,也絕不存在某種超級 計算力 ,能夠從其中 產生智慧 。而且,智慧的適應能力是整體耦合的,不是整合的,正所謂牽一發而動全身。因此,SAI那種 分而治之再總體整合的想法,根本做不出智慧 。AI發展史中有很多這樣失敗的計劃或計畫。

6、我們發現: 一、「奇異點」是偽命題;二、「記憶移植」和「數位永生」也是偽命題;三、甚至連「常識」也是偽命題 ;

7、當前,談論AGI的人有很多,但大多僅僅是泛泛而談,現在需要的是理論。 離開堅實的理論,我們走不遠的 ;

8、套用我喜愛的電影【山村老屍】中的一句話「我們一直被屍油搞錯了方向」,在此換成「 我們一直被大腦搞錯了方向 」。探尋智慧的本質,可以有很多途徑,而 透過解析大腦來研究智慧無疑是最艱難的幾條路徑之一 。因為大腦是智慧的生命載體,同一個器官承載了兩種不同的能力,你說腦內的灰質和白質,還有一堆形態各樣的精神組織,那些功能是關於生命能力的,那些功能是關於智慧的?難以有效區分,彎路多多,如果覺得這條路是必然之選,那請您了解一下精神病學再回來看這個問題吧!莫不如研究AGI,還更純粹些,也更直接。所以, 絕不是只有先研究明白了大腦,才能搞透AGI,真實的情況其實恰恰相反,借助AGI我們可以反過來推動腦科學、神經科學及精神病學的研究 。

9、AGI不是一個學科的問題,是 多學科深度交叉的問題 ,是有關人的學問中最本質的問題,跟心理學、邏輯學、精神病學、教育學關系更密切,但也與電腦科學、腦科學、哲學、社會學、人類學等學科有關。不過,僅從某一個學科出發,比如高大上的某種先進的演算法或者某個哲學中的新名詞,其效果大多只是隔靴搔癢而已;

10、我做的是AGI的科學研究,既lonely又苦逼,識貨的人也少得可憐,跨的領域太多課題也申請不上,不過沒事,我倒是信心滿滿,我這科研不為名不為利、不求SCI或SSCI,JUST FOR FUN而已,大家等我們的好訊息吧;

11、如果有路過好奇者,可以看看這裏,是我們AGI組織三年的 官方活動內容 ,做AGI我們是認真的:

16-17年:https:// home.x-in-y.com/course/ view.php?id=35

17-18年:https:// home.x-in-y.com/course/ view.php?id=34

18-19年:https:// home.x-in-y.com/course/ view.php?id=52

12、 對於培養後代最大的啟示就是 :人的肉體並不是特別重要的,最重要的是自己的精神世界,我們叫做個體的經驗系統。這個系統先天知識為0,遺傳給我們的技能在出生後起作用,這很快就被學到的社會性經驗替代了,而遺傳基因中的反射性設定,但並不是知識。個體經驗系統是活的,是成長的,也是需要培育的,可以轉置成樹狀結構,從樹的葉節點開始將直接感知經驗進行抽象,樹的根節點只有一個,就是「抽象自我」,這是人格、自尊等的上位結構。距離抽象自我越近,越抽象,層次越高,影響越大。由於抽象自我是從小開始建構的,所以我們兒時的經驗積累對於抽象自我的建構起著決定性的作用,或者可以說抽象自我就是兒時經驗的最高層次的直接抽象。難道大家不奇怪嗎,我們長大成人後,小時候的很多經歷都在無形中影響著自己,而不管你讀過多少書、上過多少學、結過多少次婚、賺了多少錢。而其中,與抽象自我直接關聯的最上方的結構與兒時生活環境直接相關,所以我一直強調:如果你沒結婚就算了,萬一你結婚生了孩子,在孩子上小學之前,千萬千萬不要想著掙錢就把孩子丟給老人,也不要只是讓女方或男方當方面地帶孩子。孩子們的成長只有一次,他們的童年也有且只有一次,對孩子抽象自我的塑造不可逆、對孩子教育的影響不可逆,哪怕生活很艱難很困苦,只要有父母的陪伴、只要這個窮家是幸福的,孩子的內心就是健康的。錢,可以回頭再掙;但,孩子內在經驗結構的缺陷卻是永無補救的。比如,留守兒童,小時候還不太容易看出來,但婚後和工作後,跟健全家庭的孩子們的差別就會越來越明顯。這個問題現在很嚴重。

13、鑒於目前私信、評論本回答的對智慧、對智慧系統目標生成和維持、任務執行等多種更為具體的問題,在此附加王培教授智慧論的 科普文集(AGI入門) 連結地址如下:

【 當你談論人工智慧時,到底在談論什麽? 】(介紹AI的幾大學派,我們是最後一個原則派)

【 人工智慧:何為「智」? 】(對智慧理解的差異,是AI和AGI的根本不同,此文說明了我們的智慧觀為什麽是有限適應)

【 電腦能有創造性嗎? 】(有人說,機器絕不會擁有創造力,那是人類才有的。其實,當然不是這樣)

【 「意思」是什麽意思? 】(能否具有理解能力,而非現在的所謂機器學習能力,是AGI的一個核心標誌,也是語意落地這個歷史性難問題的核心,我們的觀點很明確:基於經驗的語意學)

【 證實、證偽、證明、證據:何以為「證」? 】(我們腦中的知識,究竟是如何起作用的?這屬於知識論範疇的回答)

【 人工智慧迷途:電腦的高技能等於高智慧嗎? 】(算力牛X的機器,也許一點智慧都沒有)

【 人機大戰賽前思考 | 電腦會有超人的智慧嗎? 】(AlphaGo的分析)

【 機器是如何被騙並騙人的? 】(不要過度迷信專用人工智慧)

【 人工智慧危險嗎? 】(適應力系統的危險性和人類一樣,有好的也有壞的,全看教育是怎麽塑造它們的了)

【 圖靈測試是人工智慧的標準嗎? 】(結論就是,圖形測試根本不能構成AI的智慧判別標準。時下,有些人專門測試AI系統的人類年齡,比如達到3歲小孩等,都是liars)

【 你這是什麽邏輯? 】(用什麽樣的邏輯能夠解決現在深度神經網路搞不定的事呢?)

【 深度神經網路會產生人這樣的智慧嗎? 】(答:不能)

【 電腦將擁有『常識』?還有很多關要闖 】(你覺得常識不重要?好吧,你肯定不是做AI的)

【 機器轉譯會迫使轉譯們全失業嗎? 】(基於統計的機器轉譯不會的,但若是基於理解的呢,就......)

【 人工智慧怎麽為自己設定目標? 】(AGI系統如何給自己設定目標,從內在新生目標)

【 杞人憂天2.0:你真的了解「通用人工智慧」的定義嗎? 】(不存在「奇異點」一說)

14、放兩個Demo把,省的SAI的人認為我們每天只能空談理論:

(1)跨越障礙。NARS系統本身並不含有任何跨越障礙的預設演算法,一開始只是告訴系統可以做的基本動作,然後設定一個目標,接下來就是自學了。剛開始還比較笨,後來動作和預判就進步了:

https://www.zhihu.com/video/1040658897673170944

https://www.zhihu.com/video/1040658897673170944

(2)內部經驗空間。也許這就是大腦裏的工作的一個場景吧(開玩笑),都是即時工作的。

https://www.zhihu.com/video/1040647219413708800

https://www.zhihu.com/video/1040647219413708800

(3)這是1.6的版本學習打桌球的過程。

https://www.zhihu.com/video/1040659123393773568

https://www.zhihu.com/video/1040659123393773568

--------------------------------

如果大家想進一步了解AGI與教育的相關問題,請參閱以下論文:

[1]劉凱,隆舟,劉備備,王偉軍,王培.何去何從?通用人工智慧視域下未來的教師與教師的未來[J].武漢科技大學學報(社會科學版),2018,20(05):565-575.

[2]劉凱,胡祥恩,馬玉慧,那迪,張昱華.中國教育領域人工智慧研究論綱——基於通用人工智慧視角[J].開放教育研究,2018,24(02):31-40+59.

[3]劉凱,胡祥恩,王培.機器也需教育?論通用人工智慧與教育學的革新[J].開放教育研究,2018,24(01):10-15.

或到專欄:通用人工智慧 下檢視

-------------------正文部份-----------------------

一、相關概念的解釋

近期,對於人工智慧的觀點,同時存在如下三種理解:第一種,認為人工智慧包括計算智慧、感知智慧和認知智慧三種;第二種,認為人工智慧分為弱人工智慧和強人工智慧兩種,而強人工智慧也正是通用人工智慧;第三種,認為人工智慧分為專用人工智慧和通用人工智慧兩種。也即:

AI = Computational Intelligence + Perceived Intelligence + Cognitive Intelligence

AI = Strong Intelligence + Weak Intelligence

AI = Special-purpose AI + Artificial General Intelligence

到底哪種更合理呢?

第一種分類常見於行業演講和報告中,既缺乏理論依據,又具有誤導性:邏輯上貌似完整無缺,又與「奇異點」不謀而合。其中,計算智慧(又稱運算智慧)指的是快速計算和記憶儲存能力,感知智慧指的是視覺、聽覺、觸覺等感知能力,認知智慧則指抽象理解的能力。對於計算系統而言,計算智慧對應於計算水平,感知智慧對應於感知水平,而認知智慧則對應於認知水平,三者由低至高逐級更加「智慧」。現在計算智慧和感知智慧業已成熟,那麽隨著技術的發展,在給定這一框架的前提下,認知智慧也應該可以實作,畢竟前兩者已經做到了。然而,無關乎最後的認知智慧是否最終必然實作,關鍵問題在於框架的前提就有問題。事實上,計算能力和感知能力只是實作智慧的必要條件,而不是智慧本身,所以將計算智慧和感知智慧也劃入智慧的分解只是一個玩弄邏輯概念的把戲而已,在不能夠真正地解決任何實質性問題的同時卻極大提升了「認知智慧必定能夠實作」的信念和預期。因此,如果不能詳實檢視這個前提,那麽所得到的後續結論便經不起推敲。

第二種分類多見於哲學論述中,最早由賽爾提出(Searle J,1980)。他認為,弱人工智慧的電腦其價值主要是為心智探索提供有效的工具,而強人工智慧則意味著某種程式化系統的執行本身就處於心智狀態中,能夠真正理解事物並具有自己的認知狀態(唐熱風,1998)。對此,徐英瑾專門撰文寫道:大眾理解的「強—弱」之分在於智慧的寬與窄之分,而塞爾心中「強—弱」之分卻是真假之分。然而,這種區分並不是沒有意義的,起碼說明了「人工智慧在各個領域內的量的積累,未必會導致真正意義上的智慧的湧現」(徐英瑾,2018)。於是,在賽爾看來即使一個電腦系統的外在表現完全像人,那也只是個「弱人工智慧」,而「強人工智慧」必須真正擁有自我意識。這是很多通用人工智慧研究者不認可的,因為在此分類下人工智慧系統的「強弱」之別就沒有任何外部標準來衡量了(王培,2016)。可以看出,「強人工智慧」並不是智力能夠全面接近乃至超越人類智慧的機器智慧,而「弱人工智慧」也不是指對人類智慧的某些方面的模仿。所以,從原始學科向其他學科的概念「轉移」中,其內涵和外延已經發生了變化,正如「奇異點」一樣。

第三種分類則出自人工智慧技術領域自身,即認為人工智慧包括專用人工智慧(Special-purpose AI,SAI)和通用人工智慧(Artificial General Intelligence,AGI)兩個不同的子領域。對於「智慧」理解的根本差異,使人工智慧分化成為專用和通用兩個不同分支。專用人工智慧采取先做後思的路徑,即一開始並不深究智慧也不對智慧做清晰的定義,而是透過技術叠代漸進式地提升智慧化的程度。通用人工智慧認為智慧的存在代表著可以被認知的理性原則,采取的是先思後做的路徑(劉凱,胡祥恩等,2018)。與人工智慧早期工作時所使用「AI」非常相似,「AGI」的表述在2005前後被核心研究群體認可和采用,希望將他們的目標與當前「AI」(即SAI)區分開來。隨後,AGI學會的年會及其學報於2008年及2009年相繼啟動。由於AGI計畫的做法往往與主流AI社群有重大差別,所以盡管近年來「AGI」一詞大熱,但相關研究成果卻基本鮮為人知。

因此,上述 三種分類既有關聯,又彼此不同,且三者不能簡單等同 :「計算智慧+感知智慧」既不能簡單等同於「弱人工智慧」,也不能簡單等同於「專用人工智慧」。同樣地,「認知智慧」既不能簡單等同於「強人工智慧」,也不能簡單等同於「通用人工智慧」。事實上,也只有第三種分類適用於當前語境下的嚴謹討論。

二、智慧觀

「什麽是智慧?」,對於智慧本質的不同理解是當前人工智慧領域諸多流派形成的根源。

(一)常見觀點總結

我把王培老師的總結轉譯過來列舉如下:

基本觀點:既然人類智慧是人腦的產物,那麽"盡可能按照原樣復刻人腦結構"便是利用電腦實作智慧的可行途徑

理論基礎:神經科學,生物學,等

典型代表:HTM,Vicarious

主要挑戰:有太多生理細節既不可能也無在AI系統中復制的必要

基本觀點:智慧表現為人類的外在行為,所以只需讓電腦表現得"與人一樣"即可

理論基礎:心理學,語言學,等

典型代表:Turing Test,cognitive model

主要挑戰:有太多心理和社會因素既不可能也無在AI系統中復制的必要

基本觀點:人們通常智慧可以問題解決能力來測試智力,因此智慧系統也要能夠解決現在只有人類才能解決的那些問題。

理論基礎:領域知識導向下的電腦套用

典型代表:AlphaGo,expert system

主要挑戰:缺乏對智慧問題的界定,專用解決方案的通用性和彈性不足

基本觀點:智慧是諸如感覺、推理、學習、行為、交流、問題解決等一系列認知功能的整合。因此,在電腦中分而治之地實作這些功能就能夠實作智慧。

理論基礎:電腦科學

典型代表:主流AI教材,Soar

主要挑戰:AI技術發展至今內部已經相當分散和僵化,難以有效整合。

基本觀點:智慧是一種理性或最佳化的形式。因此,智慧系統應該總是能夠按照某種通用原則而「正確做事」。

理論基礎:邏輯學,數學,等

典型代表:AIXI,NARS

主要挑戰:智慧和認知中的影響因素太多,以至於難以被一種理論解釋或生成。

自上而下,上述派別對人類智慧的描述對應於越來越通用化的理論以及相應電腦中的系統實作。由於對智慧的不同描述具有不同的粒度和範圍,盡管各個派別的目標相關,但依舊差異明顯、相互不相容。實作其中某一目標的最優方式卻往往對其他目標的實作幫助有限。[更為詳細的討論請見這裏]

(二)我們的智慧觀

人工智慧當前的混亂現狀,根源於對智慧本質理解的差異。我們認為,「智慧」不是解決具體問題的能力,而是習得這些能力的元能力,即是否智慧不在於能做到什麽,而在於在何種條件下做到。進而提出, 「智慧」本質上是一個系統在知識和資源相對不足情況下的適應能力 。這種「相對不足」表現在三個方面:1) 有限性 ,智慧系統只能依賴於有限的資訊加薪資源,比如處理器數目和速度以及儲存空間容量。對於智慧機器人而言,有限性也包括能量儲備和直接感知運動能力;2) 即時性 ,智慧系統必須即時工作,新任務可能在任意時刻到來且均有時限要求,因此多個任務會競相爭奪系統資源;3) 開放性 ,智慧系統必須對未來經驗抱持完全開放的態度,新知識可能和已有知識相沖突, 新問題也亦可超出系統的知識範圍,但均不應導致系統癱瘓。

首先,「知識和資源相對不足」需要進一步澄清。「資源不足」是說,盡管系統的資訊加工能力(處理器數量、速度,記憶體容量,等等)是有限的,它卻必須即時工作,即新任務可以隨時出現,且帶有時間要求。因此時間不足(沒時間想)、空間不足(沒地方裝)是常態。「知識不足」是說新任務常常超出已有知識的範圍,而且所有已有知識都可能被新知識挑戰。

這些不足是以往的理論模型(經典邏輯、機率論、圖靈機)所未完全考慮的。盡管每個具體系統都僅有有限的能力、知識、資源,但這些模型都假定,它們已經足以完成系統所需應對的任務。以計算模型為例,系統只負責解決那些它已有演算法,而且能滿足其時空資源要求的問題。對一個超出系統知識和資源範圍的問題,它基本上不能提供有價值的答復。如果你問了電腦這樣一個問題而它答不上來,那是你的錯,不是它的錯。

這不是一個智慧系統應該做的。我們經常遇到新問題,而且一般沒有時間去考慮一個問題的所有相關因素,我們的智慧恰恰是這種情形下才得以展現的,而不是體現在那些我們已經預知詳細解法,且有足夠的時間來依此行事的問題上。對後一種問題,我們會說其解決是「機械的」或「本能的」,是不需要「動腦子」的。

能夠在「知識和資源相對不足」的條件下工作只是這個智慧定義的一半,而另一半是關於如何在這種條件下體現「理性」。這裏的關鍵概念是「適應」。具體說來包含兩點:以過去的知識應對未來的情況;以有限的資源應對無限的需求。有適應能力的系統依據經驗決定自己的行為,即使在遇到前所未見的問題時,也會比照已知的類似情況定下對策。當需要考慮的事情超出系統的思考能力時,適應力意味著集中精力於最重要的事情,而什麽是「重要」的,也是根據過去經驗確定的。

既然系統對未來經驗抱開放態度,那就是承認了未來經驗和過去經驗可能不同,因此也就無法保證自己行為的絕對正確性。在這裏,「適應」是一種「盡力而為」的努力,其合理性是不以結果的成敗而論的。因為目前的應對都會成為未來的經驗,即使失敗的嘗試也會對未來的決策做出貢獻。在一個相對穩定但仍充滿變化的環境中,「盡人事,聽天命」比「以不變應萬變」和「既然天意難測,何妨任意為之」更體現適應力,因此更合乎理性。這種理性是相對於系統的以往經驗和當前資源供應的,因此可以解釋系統的錯誤。「智慧」絕不是「全知全能」,但就算錯,也要錯得情有可原。

當我們考察一個系統的智慧時,其著眼點一般不是看它能解決什麽問題,而是看其能力是事先確定並無法改變的,還是在經驗中逐漸形成並保持一定的可塑性的。這也正是傳統的電腦系統和人腦的主要差別。即使是現有的各種機器學習演算法,也仍然是基於各種知識資源相對充足的假設,並且其學習結果往往收斂於一個確定的輸入—輸出對映。按照這些傳統觀點,每個問題都有一個「正確的」解,和系統的經驗與處境無關。但根據上述「相對理性」,什麽樣的解是「正確的」常常(盡管並非永遠)是和系統的經驗與處境有關的。

如此一來,本文所描述的這個智慧定義和其它智慧定義的關系也就清楚了。按照這個標準,一個智慧系統不必在內部結構或外部行為上和人腦「形似」,但必須在理性原則上與其「神似」。一個電腦系統是否有智慧,不在於某一個時刻它能解決什麽實際問題,而在於它提供的解是否依賴於系統的歷史和處境。

三、我們的學習觀與「奇異點」論

我們的學習觀是一種「大」學習觀,指的是同時涵蓋了機器學習和人類學習兩種貌似不同學習行為的一般意義上的學習的基本看法。

「奇異點」(Singularity),也被稱為「技術奇異點」,是從數學和物理學科中泊來的一個概念。 盡管常見於影視文學作品而為公眾所熟知,但它卻並不是一個真正意義上的電腦科學或技術術語 。歷史上,1982年美國人工智慧協會年會上Vinge首次提出「技術奇異點」,並於1993年再次論述了這個觀點(Vinge V,1993),並認為技術奇異點有可能在未來50年左右就會出現。2005年,在【The Singularity is Near: When Humans Transcend Biology(奇異點臨近)】一書的推動下,「奇異點」的翻版──「庫茨維爾定理(Kurzweil's Law of Accelerated Return)」被廣泛宣傳。該定理指出,人類出現以來所有技術發展之初都是緩步前行的,但隨後以指數的形式快速增長,並最終以指數的指數形式增長。因此,「超級智慧」(Super Intelligence)必將出現並威脅人類自身(Kurzweil,2004)。

針對人工智慧,「人工智慧將走向奇異點」(「奇異點」論)基於如下前提:

- 系統的智慧水平可以表征為一個數值;

- 經由學習或叠代改進,人工智慧主體能夠不斷提升自己的智慧水平;

- 當人工智慧超越人類智慧水平之時,它的整個未來將被視作一個單點,因為那以後的發展已經超出了人們的理解力。

第一句話看似有理,畢竟一個「智慧」或「智慧」的系統應該可以解決許多問題,而人們也總是利用各式測驗和檢測來評估效果,比如人類自己便使用「智商」(IQ)來衡量智力水平。然而,智商的準確性和科學性一直存在相當大的爭議(史帝芬▪默多克,2016)。即便存在,它也無法體現智慧的變化因素。通常情況下,提及智慧一般與「後天習得的解決問題能力」相關,而非「先天偏好設定的問題解決能力」。於是, 在某一給定時刻T,系統的智慧應該用該時刻能力的增速來衡量,即可用S(t)表示「問題解決的能力」,而用其導數S' (t)表示「學習的能力」 。

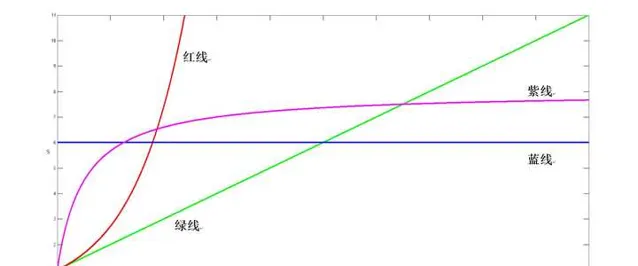

如圖1所示,依據系統所能解決問題的數量S與時間T的關系大致可區分出四類不同系統(Wang P et al.,2018):①藍線對應於一個完全沒有學習能力的系統。系統技能全部由先天給定,即S' (t) = 0。所有傳統的計算系統都屬於此類,其中一些被視為「AI」;②紫線對應於一個學習能力有限的系統,絕大多數的機器學習演算法都屬於該類。盡管S' (t) > 0,但最終將收斂到0;③綠線對應於一個學習能力基本固定的系統,許多AGI計畫都屬於這種型別。此時,S' (t)是一個正常數;④紅線對應於一個學習能力本身無限增長的系統,其S(t)和S' (t)均呈指數遞增。雖然我們認為這樣的系統並不可能真實存在,但為了討論方便而將其作為一種可能概念列出。

取決於諸函式中所包含的常量和測量的時刻,在某時刻這四種型別中的任意一種都可能成為當時問題解決能力的最強者。但它們的學習能力卻各不相同,由弱至強可排序為:藍線族 < 紫線族 < 綠線族 < 紅線族。所以, 「能夠解決多少問題」與「能夠學到多少東西」其實並不一般相關 。

盡管學習往往與問題解決被置於同一層面,但「學習是智慧核心」的見解卻早已有之。我們也認為,各類問題的具體解決能力處於物件層次,而學習能力則是處於元層次。對「綠線族」或「紅線族」而言,S(t)雖能夠提升至任意層次,甚至「比人類聰明」,但受傳感器、動作器及經驗所限,並不意味著每個問題都能比人解決得更好。在這一問題上,「綠線族」和「紅線族」之間存在根本差別:由於「綠線族」內部的元層次知識由其設計者指定,所以即使S(t)值遠高於人類水平,但人們仍然能夠理解它的執行原理及基本工作過程。而相反,若真的存在某個「紅線族」,它將在某個節點之後讓人連它是如何工作都變得無法理解。

雖然「奇異點」的支持者經常用「指數增長」現象進行佐證,但指數增長根本不會在某個自我改進的孤立系統中持續進行下去,而通常體現在族群之中。縱然「智慧」只是一個程度的問題,但沒有證據表明「智慧水平」在「人類水平」之上依舊可以無限提升。對應於「低於人類水平的智慧」,「超級智慧」作為一種邏輯類推,卻包含物件層次及元層次的雙重提高之意。S(t)值顯然可以透過知識、技能或計算資源任意一點或多點的增長而提高,但「超級智慧」和S(t)值並不相同。在元層次上,「超過人類」的智慧將是一種徹底不同的「上帝」思維機制,不論在何種情況下都能找到全域最優解。當然,盡管不否認這種可能性,但至今並沒有其確實存在的任何確鑿的支撐證據。 因此,基於我們的智慧觀和學習觀,「奇異點」是永遠無法實作的。

四、我們的教育觀

表面上看,人工智慧似乎和教育學相距甚遠,實則不然。不論專用人工智慧還是通用人工智慧都與教育學關系密切。盡管相關研究極為匱乏,但機器學習和機器教育兩個不同問題的分化卻逐漸明晰。

機器學習(Machine Learning,ML)是當代專用人工智慧的技術核心,聚焦於從數據中發現規律的演算法,將學習問題定義為訓練經驗對任務執行時效能改善的度量(Jordan M I,Mitchell T M,2015)。機器學習最初僅是電腦科學的一個子領域,但隨著統計學習帶動下人工智慧的興盛,機器學習已經成為具有嚴謹體系和理論基礎的學科。機器學習除了以回歸、決策樹、SVM、貝葉斯等演算法為主的經典符號主義外,還有以深度學習和強化學習為核心演算法的連結主義和行為主義兩個分支(馮銳,張君瑞,2010)。盡管機器學習套用甚廣,深度學習和強化學習更是成效斐然,但此類「學習」卻過於狹窄:本質乃是空間搜尋及函式泛化,實則將學習過程等同於計算過程,僅僅是預設演算法基礎上輸入輸出的重新投射而已,並無多少智慧可言(Fabio Ciucci,2017)。

比機器學習更進一步的是,通用人工智慧面向機器教育(Machine Education,ME)問題。以NARS系統為例,相同的教學內容(待輸入知識集),一次性「填鴨」灌輸與分批漸次錄入相比,其學習效果完全不同,後者更勝一籌;分批漸次錄入與錄入過程中適時向NARS發問相比又有很大差異,後者效果最為理想。對於不同的教學內容,知識組織方式對學習效果影響甚大,學習材料由淺至深則比由深至淺的效果好,知識的模組化輸入又比分散輸入的效果好。由此可見,通用人工智慧系統的學習理論,不僅涉及教學的內容,也同樣涉及到教學的方式和方法。因此,其已然沖破「機器學習」演算法的藩籬,而跨入更為廣袤的「機器教育」層次之中。

上述「教」的問題,同時存在於專用人工智慧及通用人工智慧領域之中。不過,教育不僅僅只是「教」。真正的教育,既要「教」又要「育」。對專用人工智慧而言,其演算法具有專用性,特定問題的解決有賴於特定演算法及相應參數。一旦訓練完畢,輸入輸出之間的對應關系便確定下來,計算時並不會發生改變。 專用人工智慧的特點是「演算法即教法」 ,因此有「教」而無「育」。然而, 通用人工智慧卻「教」與「育」都需兼顧 。通用人工智慧之所以冠以「通用」二字,就是因為其不預設解決具體問題的任何演算法。從最初一無所知的機器嬰兒到具備外部世界的基本常識,從簡單的人機對話到掌握一定的實用技能,從被動接受外部資訊到按自身興趣「量體而尋」,每個成型的通用人工智慧系統皆是培育出來的,整個過程和人類培養自身後代一樣,只是速度和效率有異而已。不過,正所謂「近朱者赤近墨者黑」, 通用人工智慧系統的教育經歷對其道德判斷和最終行為具有決定性影響 。在其成長之路上,「好人」能夠培育出「好的」系統,「壞人」能培育出「壞的」系統。由此可見,「教」和「育」二者皆不可偏廢。

更深入地,一方面,通用人工智慧類似人腦,可以有效利用小數據,且結果總是可分析、可解釋和有意義的,這是經驗導向的技術回歸;另一方面,通用人工智慧本身的教育問題,令人文關懷得以保持和傳承,其強調教育過程中教育者和學習者雙向互動和建構的重要性,彰顯了人文精神的回歸。通用人工智慧的教育問題包含「教學」與「育化」兩方面,前者指通用人工智慧系統的機器教育該如何實行,即「教材」和「教法」;後者是如何培養及規範「機器學生」的品行而與人為善,即教學過程中的「德育」。

對於「教材」和「教法」,機器教育可以參照人類的教育過程。以NARS為例,在最初的系統測試和執行中,我們一開始沿用機器學習「灌數據」套路,經無數次失敗和調優後驚奇地發現,所有提升NARS學習效果的做法其實同樣適用於人類。這意味著一定存在比當下內涵更大也更為一般和普適的教育範疇,這為教育研究工作者開啟了一扇通向新知的大門。直至今日,在NARS系統習得「新知」、獲取「信念」、透過操作掌握「技能」之時,「由淺入深」及「適時適度」的人類教學原則仍被恪守。然而,必須說明的是,與人類相仿,「知道」並不意味著「懂得」。 通用人工智慧系統不僅可以為自己設定目標,而且其背後所依據的信念也可以發生變化。簡單地輸入並賦予高信度的「愛護人類」「維護地球和平」等知識盡管簡單易行,但這種缺乏理解的知曉也只是教條而已,實效欠佳 。德行不是說教而是透過經驗的積累和塑造的,「育」乃是一個人類和通用人工智慧系統共同存在的操作性難題。